AIは、急速な進化により今やマーケティング業務において欠かせないものとなってきました。

弊社もデジタルマーケティング会社として一早くからAIによる自社業務の自動化・効率化を進め、現在では80%の業務のAI化を実現しています。

自社業務のAI化の経験に基づきリリースした、マーケティング業務のAI化・自動化サービス「マーケティングAIX」も、多くのお客様からご好評をいただいている次第です。

この記事では、マーケティングAIXを通じて自動化・効率化した業務の実例を、Before/After・仕組み・運用ノウハウ・陥りがちな失敗まで含めて紹介していきます。

「ChatGPTやClaudeを導入したけれど業務は変わっていない」「AIで何ができるかは分かるが、自社で何から始めればいいか分からない」——そんな状況にある方に向けて、机上の理論ではなく、実際に運用して効果が出ている自動化事例を詳細に記載しています。

掲載する事例は、シュワット株式会社が社内マーケティング業務で構築・運用しているものです。

今後この記事は20、30、50事例と拡充されていく予定です。

- PM×現役マーケター×AIエンジニアの体制で強力支援

- 貴社のマーケ業務を棚卸しし、AI自動化できる業務と優先順位をその場で整理

- 初回打ち合わせで自動化ロードマップをお渡し

マーケティング業務の80%は、AIが代替可能です。「AI活用したい」「業務を効率化したい」「外注費を抑えてアウトプットを伸ばしたい」とお考えでしたら、ぜひ弊社のマーケティングAIX無料相談をご活用ください。マーケ業務に特化したAIエージェント・AIワークフローの設計・実装を、戦略立案から導入、運用、内製化まで一気通貫で支援します。サイト制作・記事制作・SEO・広告運用・LP制作・SNS運用・PR・データ分析など、あらゆるマーケ業務の自動化事例をもとに、貴社に最適な自動化プランをご提案いたします。ぜひ下記よりお気軽にお問い合わせください。

お問い合わせはこちらシュワット株式会社のマーケティング業務AI化ソリューションをチェック

- マーケティング業務をAI化・自動化したい⇒「マーケティングAIXについて詳しく見る」

- マーケティング業務の自動化事例集を見たい⇒「自動化事例集をダウンロードする」

なぜ「いま」マーケティングのAI活用が転換点なのか

マーケティング組織は、近年以下のような3つの課題に直面しています。

- 採用難・人件費高騰

- チャネルの多様化と業務の複雑化

採用難・人件費高騰

優秀なマーケターはそもそも市場にほとんどいません。

- 経験者の優秀層を求めて求人を出しても応募がまったく集まらない。

- 未経験の優秀層は入社して1〜2年で成長して、転職か独立。

こんな状態か常態化しています。

渡邉

渡邉そもそも優秀なマーケターは独立すれば、簡単に年収2000万円くらいになるので、構造上優秀な層が転職市場に流れにくいのです。

また、マーケターに限らず売り手市場が加速する日本において、人を増やすことで業務量に対応する従来型のスケーリングは、コスト・時間・採用市場の3点で見直しが必要になりつつあります。

チャネルの多様化と業務の複雑化

マーケティングで扱うチャネル・ツール・指標は、ここ数年で大量に増えました。

検索系(SEO/LLMO)、SNS(X/Instagram/TikTok/LinkedIn)、動画、メール、LINE、コミュニティ、PR、コンテンツ、広告——

1人のマーケターが日常的に触るチャネル・ツールは10個を超え、KPIもファネル各段階の数値、LTV、CAC、ROAS、ブランドリフトなどと多層化しています。

例えCMOクラスの人材でも、1人ですべてを処理しきるのは、もはや不可能に近いです。

AI先行企業との生産性格差の急拡大

AI活用を本格化させた組織と、未着手の組織の間で、月単位で生産性差が広がり始めています。

コンテンツ制作量、分析速度、施策実行スピード——いずれの指標でも肌感ベースで3〜10倍以上の差が生まれており、この差はAIのさらなる進化とともに指数関数的に拡大します。

実装したAIは運用を通じて改善され続け、組織内に蓄積される資産なのです。

AIは育てれば育てるほど、自社業務を理解し、優秀になっていきます。

実質、社員に等しいとも言えます。

AIツール導入だけでは、解決しない

多くの企業がChatGPTをはじめとする生成AIツールを全社導入しましたが、「導入したが効果が見えない」と回答するケースが大半です。

また意外かもしれませんが、経験上、大手企業ほどこうした状態に陥りがちです。

ツール導入と業務再設計は別物だというのが、主な理由です。

| ツール導入 | 業務再設計(AX) | |

|---|---|---|

| 焦点 | 個別タスクの効率化 | 業務フロー全体の最適化 |

| 主体 | 各従業員の使い方次第 | 組織として標準化された実装 |

| 再現性 | 担当者依存 | プロセスとして再現可能 |

| 蓄積 | 個人スキルとして散逸 | 組織資産として蓄積 |

| 効果測定 | 困難 | 業務単位で計測可能 |

「ChatGPTでブログ記事を書いてみる」のはツール導入。

「ブログ記事制作プロセス全体を、リサーチ→構成→執筆→品質チェックの各工程ごとに最適なAI実装で自動化する」のが業務再設計です。

本記事で紹介する事例は、すべて後者にあたります。

AIを活用したマーケティング業務自動化の3パターン

業務をAI化する際の実装形態は、大きく以下の3パターンに分類できます。

- AIエージェント

- AIワークフロー

- ハイブリッド構成

それぞれの概要や違いを見ていきましょう。

AIエージェント

AIエージェントとは、自律的にゴールを目指してタスクを分解・実行・再計画するAIのことです。

判断や分岐を伴う非定型業務に適しています。

特徴:自律的な判断と行動を伴うAI実装。ゴールを与えると、自らタスクを分解し、計画を立て、状況に応じて分岐や再試行を行いながら実行します。

強み:柔軟性、ゴール志向、複雑な状況への対応力

適性業務:

- 探索型業務(競合発見、関連サイト発掘)

- 診断型業務(問題分析、原因特定)

- 判断を含む業務(提案文の生成と最適化)

例:被リンク営業先を自律的に探索・評価する実装(後述の事例「被リンク営業リスト構築の自動化」)

AIワークフロー

AIワークフローとは、あらかじめ定められた手順をAIが順次実行する仕組みのことです。

手順が標準化された定型業務に適しています。

特徴:定められた手順をAIが順次実行する仕組み。ステップが固定されており、各ステップで特定のAIタスクを実行します。

強み:制御性、予測可能性、再現性

適性業務:

- 定型処理業務(記事リライト、定期レポーティング、データ集計)

- パイプライン型業務(複数ステップの段階的処理)

例:順位改善のためのリライトを定型フローで実行する実装(後述の事例「順位改善リライトの自動化」)

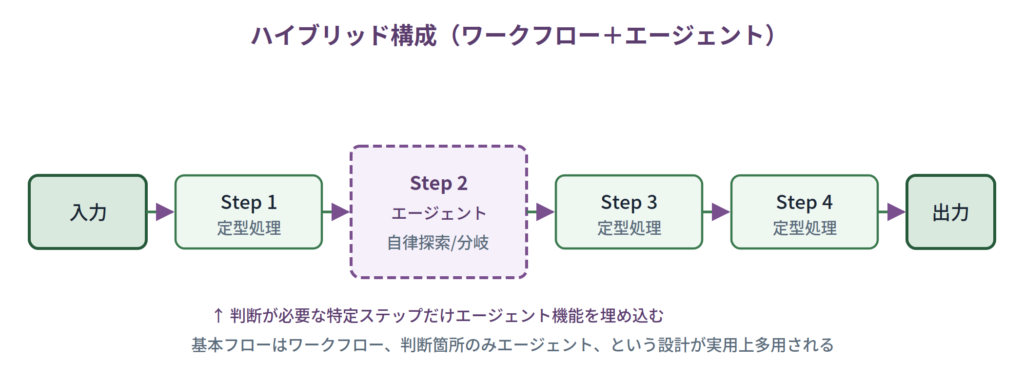

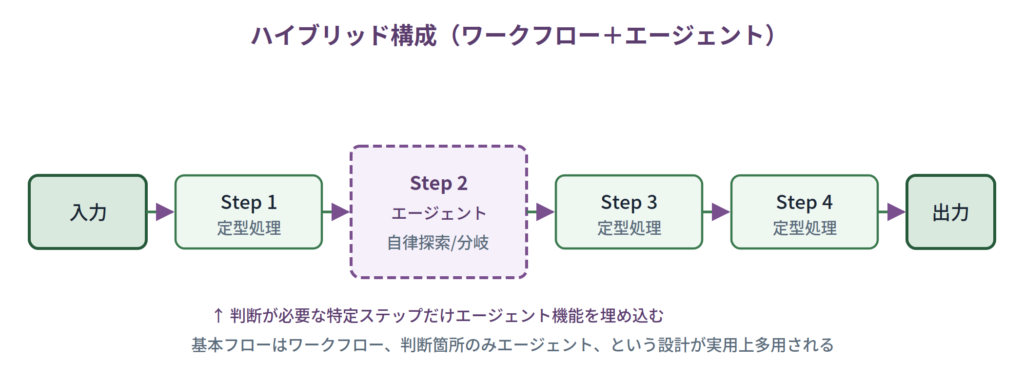

ハイブリッド構成

実は、本格的なマーケティング業務のAI化では、純粋なエージェントや純粋なワークフローよりも、両者のハイブリッド構成が最適なケースが多くあります。

具体的には

- ワークフローの中の一部ステップをエージェント化(定型処理の中で、判断が必要な特定の箇所だけエージェントを呼ぶ)

- エージェントが内部でワークフローを呼び出す(エージェントが大きな計画を立て、各ステップで定型処理を実行する)

例えば後述する「SEO記事の順位改善リライトの自動化」事例はこの典型例です。

基本フローはワークフローですが、海外記事リサーチの部分でエージェント機能を組み込んでいます。

使い分けの判断基準

業務をどちらの形態で実装するかは、以下の観点で判断します。

| 判断軸 | エージェント向き | ワークフロー向き |

|---|---|---|

| 業務手順の固定度 | 状況により変動 | 標準化されている |

| 判断の複雑性 | 高い(多くの分岐) | 低い〜中(限定的な分岐) |

| 出力の予測可能性 | 結果が事前に予測しづらい | 結果が予測可能 |

| 失敗時のコスト | 中程度(再試行可能) | 高い(厳格な品質要件) |

| 開発コスト | 高い | 低い〜中 |

| 運用安定性 | 中(チューニング継続) | 高い |

「自動化」と「半自動化」

すべての業務を完全自動化(人手ゼロ)にする必要はありません。

むしろ業務によっては、半自動化(AIが下案を作り、人が最終承認)のほうが品質と効率のバランスが取れます。

| 自動化レベル | 人の関与 | 適性 |

|---|---|---|

| 完全自動化 | 設定とモニタリングのみ | 大量処理、低リスク業務 |

| 半自動化(人が承認) | AI出力を人がレビュー・承認 | 中リスク、ブランドに影響する業務 |

| 半自動化(人が編集) | AI出力を人が編集してから利用 | 高品質要求、創造性が重要な業務 |

| 部分支援 | AIは特定タスクのみ支援 | 高度な戦略判断 |

本記事で紹介する事例は、業務特性に応じてこの4段階のいずれかを選定しています。

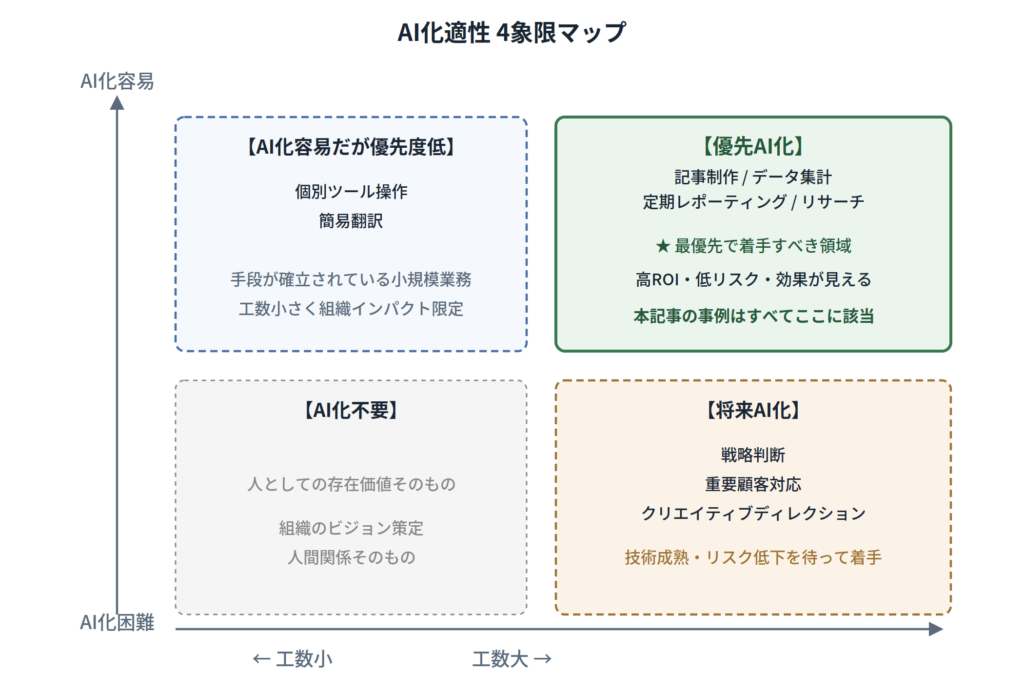

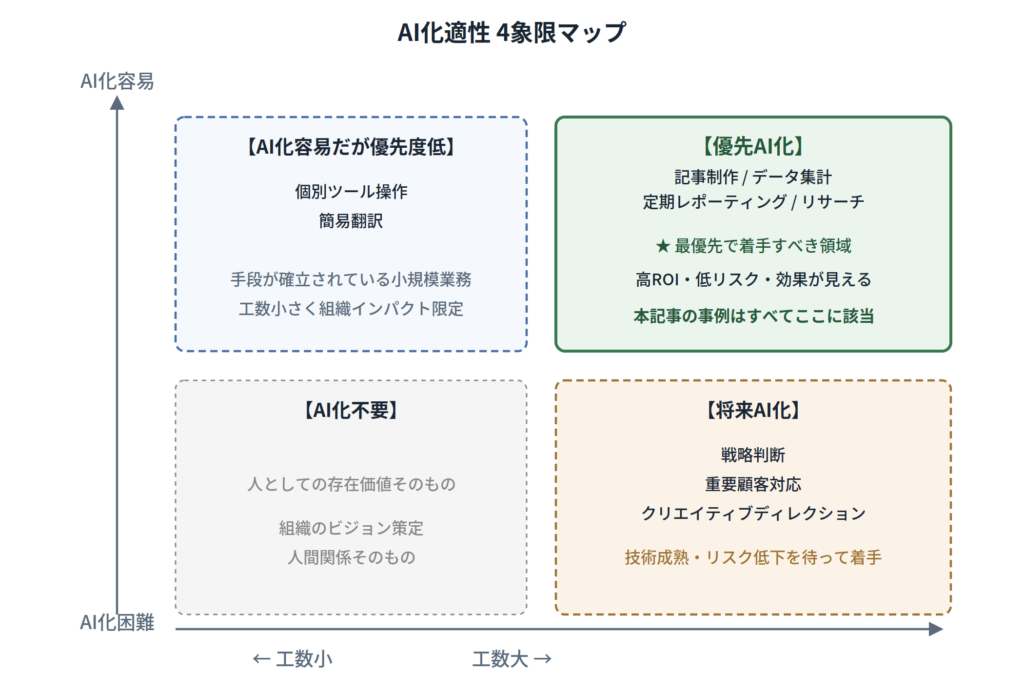

AI化適性を判定する5軸フレームワーク

すべての業務を一度にAI化するのは現実的ではありません。

優先順位を決める必要があります。

シュワットでは、業務のAI化適性を以下の5軸で評価しています。

軸① 工数規模

その業務に組織として年間何人月の工数を投じているか。

100人月の業務を10%削減するほうが、10人月の業務を50%削減するより組織インパクトが大きい。

軸② 定型度

業務手順がどれだけ標準化されているか。

手順がバラバラで属人的な業務は、AI化の前にまず標準化が必要。

軸③ AI技術成熟度

その業務領域で、現在のAI技術が実用レベルに達しているか。

テキスト生成・要約・分類は成熟しているが、複雑な戦略判断・顧客との対面コミュニケーションは未成熟。

軸④ ROI明確性

AI化することで得られる効果(コスト削減 or 売上増)が定量化しやすいか。

明確な指標がある業務から着手すべき。

軸⑤ リスク水準

AI化失敗時の影響範囲と修復可能性。社内向け業務(記事のドラフト生成)と顧客接点業務(重要顧客への返信)では、リスク水準が大きく異なる。

適性スコアマップ

5軸を統合し、業務を4象限にマッピングします。

優先AI化の象限に該当するものから、AI化を進めていきます。

AI化対象となるマーケティング業務 13領域マップ

マーケティング業務を、AI化検討のためにMECEに分解すると13領域に整理できます。

| NO. | 領域 | 主要業務の例 | AI化適性 |

|---|---|---|---|

| 01 | 戦略・企画 | 競合分析、ペルソナ設計、KPI策定 | 中 |

| 02 | コンテンツマーケティング | 記事執筆、リライト、ホワイトペーパー、動画スクリプト | 高 |

| 03 | SEO・LLMO | キーワード調査、内部リンク最適化、被リンク営業 | 高 |

| 04 | Web広告運用 | クリエイティブ制作、入札最適化、レポーティング | 中〜高 |

| 05 | SNS・コミュニティ | 投稿制作、エンゲージメント分析、トレンド検知 | 中 |

| 06 | PR・広報 | プレスリリース、メディアリスト、露出モニタリング | 中 |

| 07 | メール・LINE | シナリオ設計、配信文面、A/Bテスト | 中〜高 |

| 08 | MA・CRM | スコアリング、セグメンテーション、ナーチャリング | 中 |

| 09 | データ分析・効果測定 | ダッシュボード生成、異常検知、示唆抽出 | 高 |

| 10 | Webサイト・LP制作 | サイト制作、サービスLP制作、A/Bテスト用LP量産 | 高 |

| 11 | CRO・UX改善 | LP分析、A/Bテスト設計、改善提案 | 中〜高 |

| 12 | カスタマーサクセス・LTV | 解約予測、アップセル機会発見、FAQ自動応答 | 中 |

| 13 | オフライン・統合 | 展示会フォロー、営業マテリアル制作、統合計測 | 低〜中 |

現時点で本記事に掲載している事例は、主に02・03・04・05・06・09・10・11の領域に集中しています。

これは「現時点で最もAI化適性が高く、ROIが明確に出やすい」領域だからです。

今後事例が追加されるなかで、13領域すべてを網羅していく予定です。

AIを使ったマーケティング業務の自動化・効率化事例集

ここから、マーケティング業務をAIで自動化・効率化した具体的な事例を詳細に紹介します。

掲載事例はすべて、シュワット株式会社が自社マーケティング業務で実際に運用しているAI実装(自社事例)です。今後、他社支援事例も含めて随時追加していきます。

各事例は以下の構造で説明しています。

- 事例分類(自社事例 / 他社支援事例)

- 業務概要

- Before(AI化前の状態と課題)

- アプローチ(実装方針と判断)

- 仕組みの解説

- After(成果)

- 適用範囲(どんな組織で再現可能か)

- 横展開のヒント

- 運用ノウハウとピットフォール

事例は7つのカテゴリー(A. コンテンツ制作/B. SEO・被リンク獲得/C. LP制作・改善/D. SNS運用/E. 広告運用/F. PR・広報/G. データ分析・効果測定)に整理しています。興味のあるカテゴリーから読むことも可能です。

事例一覧

興味のあるカテゴリーから読むことができます。各事例タイトルをクリックすると、該当箇所にジャンプします。

A. コンテンツ制作(7事例)

- 事例 A-1:順位改善リライトの自動化

- 事例 A-2:CTR改善リライトの自動化

- 事例 A-3:速報挿入リライトの自動化

- 事例 A-4:データ・情報更新時の一括リライトの自動化

- 事例 A-5:新規記事制作の自動化

- 事例 A-6:ホワイトペーパー制作の自動化

- 事例 A-7:セミナースライド制作の自動化

B. SEO・被リンク獲得(5事例)

- 事例 B-1:キーワードリスト作成の自動化

- 事例 B-2:テクニカルSEO分析→改善実装の自動化

- 事例 B-3:内部リンク最適化の自動化

- 事例 B-4:被リンク営業リスト構築の自動化

- 事例 B-5:被リンク営業文生成の自動化

C. LP制作・改善(3事例)

D. SNS運用(1事例)

E. 広告運用(1事例)

F. PR・広報(1事例)

G. データ分析・効果測定(1事例)

Category A|コンテンツ制作(7事例)

リライト・新規記事制作・資料制作のフルレンジ自動化で、コンテンツマーケの量と質を両立する7事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| A-1 | 順位改善リライトの自動化 | 1記事工数 4〜8時間 → 30〜60分(約87%削減)/月処理 20本 → 200本(10倍) |

| A-2 | CTR改善リライトの自動化 | 1記事工数 1〜2時間 → 5〜10分(約93%削減)/サイト全体流入 月次5〜15%増 |

| A-3 | 速報挿入リライトの自動化 | 反映時間 数日〜数週間 → 数時間〜1日/編集者工数 約90%削減 |

| A-4 | データ・情報更新時の一括リライトの自動化 | 72記事一括更新 10数時間 → 30分(実働数分)/人間の集中投下時間 約99%削減 |

| A-5 | 新規記事制作の自動化 | 1記事 数万〜十数万円 → 社内人件費のみ/制作期間 2〜4週間 → 数時間〜半日 |

| A-6 | ホワイトペーパー制作の自動化 | 数日 → 骨子完成後10数分でスライド化/デザイナー不要、マーケター単独完結 |

| A-7 | セミナースライド制作の自動化 | 数日〜1週間 → 30分程度/台本+スライド並行生成で本番ズレを根絶 |

コンテンツマーケティングは、マーケティング業務の中でも最も工数がかかり、かつAI化の効果が最も大きい領域です。リライト4種(順位改善・CTR改善・速報挿入・情報更新)と新規記事制作、資料制作2種(ホワイトペーパー・セミナースライド)の合計7事例で、コンテンツ業務のフルレンジをカバーします。

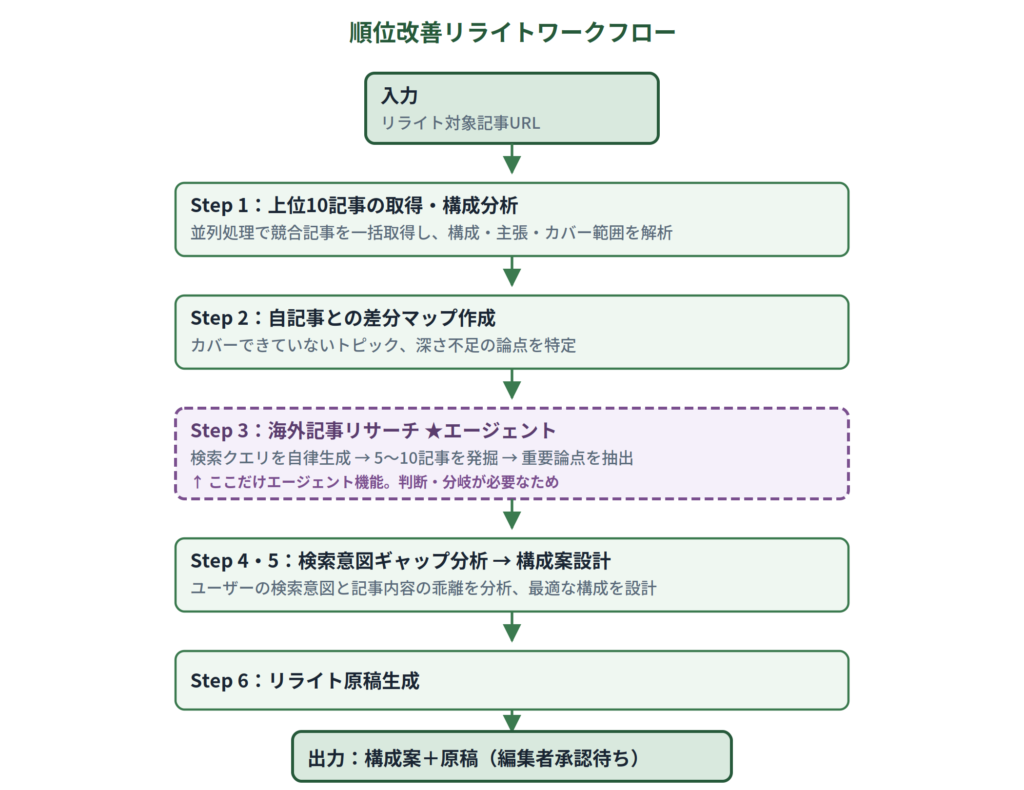

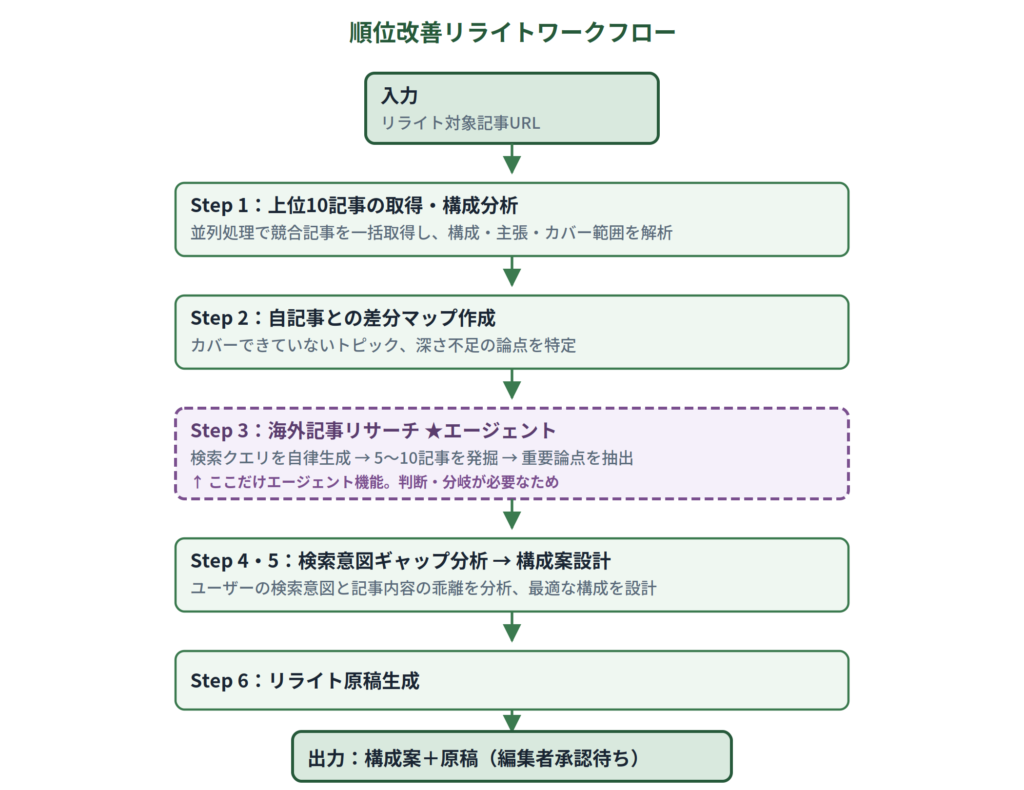

事例 A-1:順位改善リライトの自動化

人手で1記事あたり4〜8時間かかっていた順位改善リライトを、AIワークフローで30〜60分まで短縮した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 02. コンテンツマーケティング / 03. SEO・LLMO |

| 実装形態 | AIワークフロー(一部ステップにエージェント機能を内包) |

業務概要

すでに公開済みのブログ記事のうち、検索順位が4〜20位にとどまっている記事を上位化するためのリライトを行う業務。

Before:AI化前の課題

順位改善リライトは、本来は単に「記事を書き直す」業務ではありません。次の調査・分析を経たうえで、初めて意味のあるリライトが可能になります。

- 現在の検索結果上位10記事の構成・主張・カバー範囲を分析

- 自記事との差分(カバーできていないトピック、深さ不足の論点)を特定

- 海外で先行している類似トピックの記事から最新知見を抽出

- 検索意図とのギャップを分析

- リライト構成案を設計

- 実際にリライト原稿を生成

人間がこれを行うと、1記事あたり4〜8時間を要します。月20本のリライトが限界で、サイト全体のSEO改善ペースが遅すぎるという課題がありました。

アプローチ

各ステップを分解し、それぞれをAIで処理可能か検証。結果として:

- ステップ1〜2、4〜5:構造化されたタスク → ワークフロー化

- ステップ3(海外記事リサーチ):自律的探索が必要 → エージェント機能を埋め込み

- ステップ6:定型出力 → ワークフロー化

全体としてはワークフロー型だが、海外リサーチ部分のみエージェント挙動、というハイブリッド設計を採用しました。

仕組みの解説

各ステップはLLMを使ったAI処理を含みつつ、ワークフローエンジンが順次制御。Step 3のみ、エージェントが自律的にWeb検索・記事取得・要約を反復します。

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1記事あたり工数 | 4〜8時間 | 30〜60分 | 約87%削減 |

| 月間処理本数 | 20本 | 200本 | 10倍 |

| 海外リサーチカバー範囲 | 2〜3記事 | 5〜10記事 | 3〜5倍 |

| 属人化度 | 高(ベテランのみ) | 低(誰でも実行可能) | — |

※社内運用の参考値。条件により変動します。

適用範囲

再現性が高い組織:

- 自社オウンドメディアに50記事以上の公開記事資産がある

- 既存記事の上位化が事業KPIに直結する

- リライトのガイドラインが言語化できている

注意が必要な組織:

- 記事制作プロセス自体が属人的で、共通の品質基準がない

- 検索順位以外の指標(NPS、エンゲージメント等)が主要KPI

横展開のヒント

このワークフロー設計は、ブログ以外にも応用可能です。

- 製品ページの最適化(上位競合製品ページとの差分分析)

- サポートFAQの拡充(検索クエリと既存FAQのギャップ発見)

- 採用記事の改善(求職者検索クエリとの整合性向上)

運用ノウハウとピットフォール

運用上の工夫:

- 月初に「今月リライト対象記事リスト」を自動抽出(順位×流入の優先度スコアリング)

- リライト後の順位変動を週次でモニタリング、効果的な構成パターンを学習データに反映

- 編集者の承認時にコメントを残すと、それが次回以降の品質向上に活用される設計

陥りがちな失敗:

- AI生成原稿をそのまま公開すると、ブランドトンマナから外れることがある → 必ず編集者承認のステップを設ける

- 上位記事の単純な「真似」になってしまう → 差分マップに「自社独自の主張・データ」を加える設計が重要

- 海外記事リサーチが情報過多になる → エージェントに「3つの最重要論点だけ抽出」と制約をかける

事例 A-2:CTR改善リライトの自動化

検索順位は良好だがCTR(クリック率)が低い記事のタイトル・メタディスクリプションを、AIワークフローで一括改善する事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 03. SEO・LLMO |

| 実装形態 | AIワークフロー |

業務概要

検索順位は良好(1〜10位)だが、CTR(クリック率)が低い記事のタイトルとメタディスクリプションを改善する業務。

Before:AI化前の課題

CTR改善は、SEO担当者なら誰もが重要性を認識しつつ、後回しにされがちな業務でした。理由は3つあります。

- 1記事ずつ「現状CTR」「順位」「想定改善後CTR」を分析する必要があり、地味で時間がかかる

- タイトル案の生成は創造性が必要で、AIに任せるには品質が不安だった

- CTR効果を測るには公開後数週間の観測期間が必要で、PDCAが回しづらい

結果として、月に数記事のCTR改善が精一杯で、サイト全体の検索流入を大きく改善するには至りませんでした。

アプローチ

CTR改善を以下のサブタスクに分解しました。

- CTR低下記事の自動抽出(検索順位×実CTR×想定CTRの差分)

- 上位記事のタイトル傾向分析

- 記事内容の読み込みと「読者にとってのベネフィット」抽出

- 複数のタイトル案・ディスクリプション案の生成

- AIによる「クリックしたくなる度」スコアリングと候補絞込み

- 最終3案を編集者に提示

すべて構造化可能なため、ワークフロー型で実装しました。

仕組みの解説

[入力] サイトURL or 記事URLリスト

↓

[Step 1] Search ConsoleからCTR低下記事を抽出

↓

[Step 2] 各記事の上位競合タイトル取得・傾向分析

↓

[Step 3] 記事本文を要約し「主要ベネフィット」抽出

↓

[Step 4] タイトル案を10〜20個、ディスクリプション案を5〜10個生成

↓

[Step 5] LLMによる「クリック誘発スコア」評価で上位3案に絞込

↓

[Step 6] スプレッドシートに出力(編集者がレビュー)After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1記事あたり工数 | 1〜2時間 | 5〜10分 | 約93%削減 |

| 月間処理本数 | 5〜10本 | 100本以上 | 10倍以上 |

| CTR平均改善幅 | — | +30〜60%(記事による) | — |

| サイト全体流入 | — | 月次5〜15%増(継続改善) | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織:

- 既存記事数が多い(100記事以上)

- 検索流入が事業KPIに直結する

- Search Console等のデータが整備されている

横展開のヒント

- ECサイトの商品タイトル最適化(商品名・属性・ベネフィットの組み合わせ最適化)

- 広告クリエイティブの見出し最適化(A/Bテスト用の大量バリエーション生成)

- メールマガジンの件名最適化(開封率改善)

運用ノウハウとピットフォール

運用上の工夫:

- 過去のCTR改善実績データを学習に活用(自社で「ウケる」表現パターンの蓄積)

- 季節性・トレンドキーワードを動的に組み込む仕組み

- ブランドトーンガイドラインをプロンプトに明示

陥りがちな失敗:

- 「クリック誘発」を追求しすぎて煽り表現になる → ブランド毀損リスク。スコアリング基準にブランド一貫性を含める

- 順位とCTRの相関を見誤る → 順位5位以上でCTRが平均以下、という条件を厳格に設定

- 効果測定をせずに次々と変更する → 各変更の効果を2〜4週間観測してから次のリライトへ

事例 A-3:速報挿入リライトの自動化

業界の重要ニュース発生時に、関連する既存記事へ速報情報を自動挿入し、記事の鮮度と信頼性を保つAIワークフローの事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 02. コンテンツマーケティング / 03. SEO・LLMO |

| 実装形態 | AIワークフロー |

業務概要

業界の重要ニュース・アップデートが発生した際、関連する既存記事に速報情報を自動挿入し、記事の鮮度と信頼性を維持する業務。

Before:AI化前の課題

ニュースが発生するたびに、編集者が「どの記事を更新すべきか」を手動で判断し、本文を編集していました。問題は3つです。

- ニュース発生から記事更新まで数日〜数週間かかる(鮮度ロス)

- 更新すべき記事の見落としが頻発(特に過去の関連記事)

- 更新作業自体が編集者の貴重な時間を消費

検索エンジンは記事の更新頻度を評価指標の1つとしているため、この遅延が長期的なSEO評価にも影響していました。

アプローチ

「ニュース発生」をトリガーに、自動で関連記事を発掘・更新するワークフローを設計しました。

仕組みの解説

[トリガー] 重要ニュース・アップデート(手動入力 or RSSフィード)

↓

[Step 1] ニュース内容の構造化(誰が・何を・いつ・どんな影響)

↓

[Step 2] 関連既存記事の検索(タイトル・本文の意味類似度マッチング)

↓

[Step 3] 各候補記事に対し、挿入箇所と挿入文を生成

↓

[Step 4] 編集者承認用にダイジェストを送信

↓

[Step 5] 承認された記事を自動更新(CMS API経由)

↓

[出力] 更新済み記事 + 更新ログAfter:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| ニュース発生→反映までの時間 | 数日〜数週間 | 数時間〜1日 | 大幅短縮 |

| 関連記事の発掘率 | 編集者の記憶に依存(5〜10本) | 全記事から関連性で抽出(20〜50本) | 3〜5倍 |

| 編集者の手動工数 | 1ニュースあたり3〜5時間 | 30分以内(承認のみ) | 約90%削減 |

※社内運用の参考値。条件により変動します。

適用範囲

特に有効な業界・組織:

- 業界ニュースの発生頻度が高い(IT、金融、医療、法務など)

- 既存記事が多く、過去記事の鮮度維持が課題

- 速報性が読者価値に直結する

横展開のヒント

- 製品アップデートの反映(自社製品の機能追加を、関連するヘルプ記事に自動反映)

- 競合動向の追跡(競合の新発表に対し、自社の比較記事を即座に更新)

- 法改正の反映(法務系コンテンツに、最新の法改正情報を自動挿入)

運用ノウハウとピットフォール

運用上の工夫:

- ニュースの「重要度スコアリング」で、すべてに反応せず重要なものだけ更新フローを起動

- 同じニュースを複数記事に挿入する際の文章バリエーション生成(同文コピペを避ける)

- 「速報」マークの付与と、一定期間後の「速報」マーク自動除去

陥りがちな失敗:

- ニュースの真偽確認をスキップする → 公式ソースのみをトリガーとする設計

- 速報文が記事の文脈と合わない → 記事のトーンを学習させ、合わせて挿入文を生成

- 古い記事を「速報」で更新しすぎて、記事構成が崩れる → 「速報セクション」を独立させ、本文を汚染しない設計

事例 A-4:データ・情報更新時の一括リライトの自動化

外部の情報変化(仕様終了発表、公的データ更新、年度切り替え等)を受けて、関連する既存記事を一括で修正する業務を、片手間の実働数分で完了させる事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 02. コンテンツマーケティング / 03. SEO・LLMO |

| 実装形態 | AIワークフロー(Claude Code+WordPress REST API直接連携) |

業務概要

外部の情報変化(Googleの仕様変更発表、公的データ更新、法改正、年度切り替え等)が発生した際、関連する既存記事を漏れなく洗い出し、各記事に最適化された文章で情報を更新する業務。

実際の運用例として、2026年5月にFAQ構造化データマークアップのサポート終了が発表された際、サイト内72記事で言及・推奨されていたため、全72記事の情報修正を実施した事例があります。

Before:AI化前の課題

外部情報の変化に追従する既存記事の一括更新は、ユーザビリティ・SEO評価の両面で重要性が高いにもかかわらず、組織として長らく後回しにされてきた業務でした。

- 言及のある記事の洗い出しに数時間かかり、しかも精度が悪い(人の記憶や検索の取りこぼし)

- 1記事1記事を修正していくと、72記事規模で10数時間の集中作業が必要

- 工数が大きすぎるため、「対応すべきと分かっていても着手できない」状態が常態化

- サイト全体で古い情報が残り続け、ユーザビリティ低下・Google評価低下・ブランド信頼性毀損のリスクが累積

アプローチ

「外部情報の変化」をトリガーに、関連記事の発掘から各記事ごとの最適化された修正、本番反映までをClaude Codeで一気通貫で処理するワークフローを構築。

特徴は3点。

- 記事洗い出しの完全自動化+高精度化:人間の手間ゼロで、サイト内の言及記事を漏れなく検出

- 各記事に合わせた個別最適化:単純な文字列置換ではなく、各記事の文脈・トーンに合わせて適切な文章で情報を更新

- WordPress REST APIによる直接編集:人間の作業は承認のみ。他の作業の片手間で完了する圧倒的な低工数

仕組みの解説

[Step 1] 情報の更新依頼をClaude Codeに提供

- 例:「FAQ構造化データマークアップが2026年5月で

サポート終了。当該言及記事を全て修正してほしい」

- 更新元となる情報(公式発表URL、変更内容、対応方針)を渡す

↓

[Step 2] 更新方針を決定

- 「修正する」「言及自体を削除する」「代替手法を提案する」等

- Claude Codeと壁打ちしながら方針を確定

↓

[Step 3] 記事のスクリーニング

- サイト全体から言及のある記事をAIで洗い出し

- 人間の手間ゼロ、精度抜群(72記事規模も即時抽出)

↓

[Step 4] 各記事に合わせた修正案を生成

- 記事ごとに文脈・トーンを読み取り

- 単純置換ではなく、適切な文章で情報を更新

↓

[Step 5] 修正作業の実行

- WordPress REST APIで直接編集

- 人間は承認作業のみ

↓

[出力] 更新済み記事一式+更新ログ使用ツール:Claude Code(情報変化のトリガー受領、方針決定、スクリーニング、修正、WordPress入稿の全工程)、WordPress REST API(記事の直接編集・更新)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 72記事の一括更新時間 | 10数時間(集中作業) | 30分(他作業の片手間、実働数分) | 大幅短縮 |

| 言及記事の洗い出し精度 | 数時間+精度悪(取りこぼしあり) | 即時+精度抜群 | — |

| 人間の集中投下時間 | 10数時間 | 承認作業のみ | 約99%削減 |

| 対応の即応性 | 着手すらできず後回し | 発表当日に対応可能 | — |

| 情報の鮮度・ユーザビリティ | 古い情報が残るリスク | 常に最新化を維持 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- 既存記事数が多く(数十〜数百記事規模)、外部情報への追従が課題

- 業界の仕様変更・法改正・年度切り替え等のイベントが頻繁にある

- ユーザビリティ・SEO評価を継続的に維持したい組織

- 「やるべきだが工数面で後回し」になっている業務を解消したい組織

注意が必要な組織

- 記事制作プロセス自体が属人的で、トーン基準が組織として共有されていない

- WordPress以外のCMSで、REST API連携が容易でない環境

横展開のヒント

- 公的データ更新時の一括反映:統計データ、調査結果、公的指標が更新された際の修正

- 年度切り替え時の一括更新:「2025年版」→「2026年版」等の表記更新、料金・税率・制度の年度反映

- 法改正・規制変更時の一括対応:法務系コンテンツの法改正反映、業界規制変更への追従

- 企業情報変更時の一括更新:自社サービス名変更・料金改定・組織変更等の全社サイト一括反映

- 製品仕様変更時の一括反映:自社製品の機能追加・廃止に伴うヘルプ記事・ブログ記事の更新

- 競合動向追従:競合の新発表に対する比較記事の即時更新

運用ノウハウとピットフォール

運用上の工夫

- 「これまでは工数がかかりすぎて後回しにされてきた業務」を、片手間で完了できるようになる発想転換が組織変革の起点

- 情報変化のトリガー(公式発表、業界ニュース等)をRSS等で監視し、即座にClaude Codeへ連携する仕組みを整備

- 修正方針の決定段階で「修正」「削除」「代替提案」等の選択肢を明文化し、判断の一貫性を担保

- 更新ログを必ず残し、後から「いつ、どの記事を、どう更新したか」が追跡可能な状態に

- 月次・四半期で「累積的な情報更新の機会」を棚卸しし、計画的に実行する運用フロー

陥りがちな失敗

- 単純な文字列置換で済ませようとすると、記事の文脈と合わない不自然な修正になる → 必ず各記事のトーン・文脈を読み取って個別最適化

- 承認作業をスキップして自動化を進めすぎると、ブランド毀損リスク → 重要記事は必ず人間の承認を経由

- 公式ソースの真偽確認をスキップ → 必ず公式発表URLを起点に方針決定

- 更新ログを残さないと、後で問題が起きた際にロールバックできない → 必ず変更履歴を保持

事例 A-5:新規記事制作の自動化

検索意図分析から執筆、ファクトチェック、CMS入稿までを一気通貫で自動化するAIワークフローで、外注時に1記事数万〜十数万円かかっていた制作コストを社内人件費のみに圧縮した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 02. コンテンツマーケティング / 03. SEO・LLMO |

| 実装形態 | AIワークフロー(Claude/Claude Code/Ahrefs MCP/WordPress REST APIの統合構成) |

業務概要

オウンドメディアの新規記事制作を、検索意図分析・構成案作成・執筆・ファクトチェック・WordPress入稿まで一気通貫で自動化する業務。

Before:AI化前の課題

新規記事制作は、SEO/LLMOを意識した検索意図分析、構成案作成、独自情報を盛り込んだ執筆、ファクトチェック、入稿という多くの工程が存在し、組織として最も工数とコストがかかる業務の1つでした。

- 外注ベースで制作すると、1記事あたり数万円〜十数万円・2〜4週間が相場

- 月10本制作すれば、年間1,000万円超のコストが発生

- SEOディレクター・編集者の管理工数も組織内で発生

- 生成AIで安易に作るだけでは「最大公約数的で独自性のない記事」となり、検索順位もCV獲得も期待できない

- 結果として、「コストをかけても満足する品質にならない」「コストを抑えると独自性のないAI記事になる」というジレンマに陥っていた

アプローチ

新規記事制作を5つのステップに分解し、AIで処理可能か検証。結果として、Claudeを中心とした統合ワークフローを構築。

特徴は3点。

- 戦略パートを必ず設計:構成案作成前に、顕在・潜在ニーズ、競合の弱点、勝ち筋、独自価値を明文化

- 3層モデルによる引用設計:客観的事実は出典必須、自社経験は堂々と、推奨は断定可、と書き分けてWikipedia的な信頼性とブログ的な独自性を両立

- SWELL記法に自動変換して下書き入稿:執筆完了からWordPress下書き保存までをClaude Codeで実行

仕組みの解説

[Step 0] 案件知識読み込み

- ペルソナ・トンマナ・CV先・独自情報源・引用ルールを把握

↓

[Step 1] 検索意図分析(7工程)

- 親子KW整理、サジェスト・PAA・関連検索調査

- 上位10〜15記事のMECE分析

- ペルソナ深掘り、顕在・潜在ニーズ抽出

- 海外メディアリサーチ

↓

[Step 2] 構成案作成

- タイトル複数案

- 戦略パート(ニーズ・勝ち筋・独自価値・想定インパクト)

- H2/H3構成、内部リンク・CTA配置案

↓

[Step 3] 執筆

- リード文6ヶ条遵守、3層モデルで主張を書き分け

- 執筆チェックリスト24項目を満たす

↓

[Step 4-A] ファクトチェック

- 数値・固有名詞・URLの正確性確認

↓

[Step 4-B] 文章品質編集

- 1文70字以内、読点・語尾重複・表記ゆれ整理

- 装飾指示の最終整備

↓

[Step 5] 入稿(Claude Code)

- Markdown→SWELL記法変換

- アンカーリンク・CTA・関連記事カード・装飾を反映

- WordPress下書き保存

↓

[出力] WordPress下書きで完了した記事(編集者承認待ち)使用ツール:Claude(Step 0〜4-B:戦略設計・執筆・編集)、Claude Code(Step 5:SWELL変換・WordPress入稿)、Ahrefs MCP(キーワードボリューム・SERP分析)、WordPress REST API(下書き保存・関連記事カード化)

After:成果

| 指標 | Before(外注ベース) | After(AIワークフロー) | 改善率 |

|---|---|---|---|

| 1記事あたりコスト | 数万円〜十数万円 | 社内人件費のみ | 大幅削減 |

| 1記事あたり制作期間 | 2〜4週間 | 数時間〜半日 | 大幅短縮 |

| 月10本制作の年間コスト | 1,000万円超 | 大幅削減 | — |

| 戦略パートの明文化 | 外注ライターの裁量任せ | 必ず構成案に明記 | — |

| 独自情報の組み込み | 漏れる場合あり | 構成案段階で必ず3つ以上 | — |

| 信頼性(出典明記) | 担当者の意識次第 | 3層モデルで担保 | — |

| 入稿作業 | 手動コピペ・装飾 | 自動変換で下書き保存 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- マーケ部門で月数本以上のオウンドメディア記事を制作している

- AI活用を推進したいが「最大公約数的なAI記事」を量産したくない

- 戦略整理から入稿までの工程をブラックボックス化させたくない

- SEO/LLMO観点で検索評価を狙いたい

注意が必要な組織

- 案件知識(ペルソナ・トンマナ・独自情報源)が言語化されていない

- 記事制作の品質基準が組織として共有されていない

横展開のヒント

- クライアント案件のオウンドメディア記事制作(記事制作代行サービスのコア業務)

- ホワイトペーパー・調査レポートの自動生成(同様の戦略パート設計が活用可能)

- 取材記事・事例記事の構造化制作(ペルソナ・勝ち筋の整理がそのまま転用可能)

- 海外メディア向け多言語記事(同フローに翻訳ステップを追加)

運用ノウハウとピットフォール

運用上の工夫

- ワークフロー構築のハードルは「プロンプト設計」と「案件知識(project-knowledge.md)の整備」にある。これらを綿密に設計することで、誰が運用しても再現性高く、独自性のある記事が出力される

- 検索意図分析の7工程、戦略パートのフォーマット、3層モデルでの主張の書き分けをテンプレ化

- 案件特化のペルソナ・トンマナ・CV情報、独自情報源を構造化して保持

- 現役マーケター×AIエンジニアのペア体制で、自社・クライアント案件のオウンドメディアにこのワークフローを横展開

陥りがちな失敗

- 案件知識の整備が不十分なまま実装すると、「最大公約数的なAI記事」が出力される → ペルソナ・トンマナ・独自情報源は実装前に必ず構造化

- 3層モデルの書き分けが不徹底だと、信頼性と独自性のバランスが崩れる → 出典必須/自社経験/推奨断定の3軸を構成案段階で明示

- ファクトチェックを軽視すると、数値・固有名詞・URLの誤りが残る → Step 4-Aを必ずワークフローに組み込み、編集者の最終承認も必須化

事例 A-6:ホワイトペーパー制作の自動化

社内に蓄積された情報・データ資産を再活用してホワイトペーパー骨子を高度化し、スライド化までを10数分で完了させる事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 02. コンテンツマーケティング |

| 実装形態 | AIワークフロー(Claudeチャット+Claude designの2段構成) |

業務概要

社内に蓄積されたセミナー動画・公開済みブログ記事・支援事例データ等の情報資産を再活用し、ホワイトペーパーの企画・骨子形成からデザイン化・公開までを一気通貫で実施する業務。

Before:AI化前の課題

ホワイトペーパー制作は、リード獲得施策として高い効果を持つにもかかわらず、組織のボトルネックとして長らく放置されがちな業務でした。

- 社内には良い情報・データが多く蓄積されていたが、工数の多さからホワイトペーパー制作・公開が進まなかった

- きれいなスライドを制作するためには、デザイナーのアサインが必要だった

- 内製しても数日かかる作業で、マーケターは「やるべきと分かっていても着手できない」状況

- 結果として、コンテンツ資産は豊富にあるのに、リード獲得用の体系化された資料が不足し、商談化率向上の機会を逃していた

アプローチ

ホワイトペーパー制作を3段階に分解し、「企画・骨子形成」と「デザイン化」を別フェーズとして設計。特に重視したのは、社内既存資産(セミナー動画・ブログ記事・支援事例)をClaudeに渡してオリジナル骨子を生成する設計です。

特徴は3点。

- 既存資産の再活用設計:ゼロから企画するのではなく、過去のセミナー動画、公開済みブログ記事、支援事例データをClaudeに渡して「オリジナルの高度な骨子」を生成

- 骨子とデザインの分業最適化:骨子は壁打ちで時間をかけて磨き、デザイン化は10数分で完了する分業構造

- デザインシステムによる品質安定化:Claude designに事前構築したデザインシステムを参照させ、ブランドトンマナを維持した高品質スライドを瞬時に生成

仕組みの解説

[Step 1] Claudeチャットで企画検討

- マーケターが壁打ちしながらホワイトペーパーのテーマ・ターゲット・狙いを確定

- 競合資料のリサーチも並行

↓

[Step 2] Claudeチャットで骨子形成

- 過去のセミナー動画文字起こし

- 公開済みのブログ記事

- 支援事例データ

- その他社内資産

を渡して、オリジナルの高度なホワイトペーパー骨子を生成

↓

[Step 3] Claude designでスライド作成

- 骨子をベースに、事前構築したデザインシステムを参照

- ブランドトンマナを維持した高品質スライドを生成

- スライド化自体は10数分で完了

↓

[Step 4] 人間による最終編集+チェック

- 編集者がブランド独自の主張を強化

- 数値・固有名詞・出典の最終確認

↓

[出力] 公開可能なホワイトペーパー使用ツール:Claude(企画検討、骨子形成、壁打ち)、Claude design(スライド生成、デザインシステム参照)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1ホワイトペーパーあたり制作期間 | 数日(内製時)/さらに長期(外注時) | 骨子完成後10数分でスライド化 | 大幅短縮 |

| デザイナーのアサイン要否 | 必須 | 不要(マーケター単独で完結) | — |

| 既存資産の活用度 | 低(ゼロから企画することが多い) | 高(社内データを構造的に再活用) | — |

| 公開可能なホワイトペーパー数 | 制作工数のため停滞 | 継続的に量産可能 | 大幅増加 |

| ブランドトンマナの一貫性 | デザイナー個別判断 | デザインシステムで自動担保 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- 社内にセミナー動画・ブログ記事・支援事例等の情報資産が蓄積されている

- ホワイトペーパーをリード獲得の主要施策として活用したい

- マーケ部門に施策スピードと裁量を持たせたい

- ブランドガイドラインがある程度言語化されている

注意が必要な組織

- 社内資産が構造化されていない、または公開許諾が整理されていない

- ブランドガイドラインが暗黙知に依存している

- 高度な専門性が要求されるテーマで、社内情報のみでは不十分

横展開のヒント

- セミナースライドの自動制作:同様の骨子形成→デザイン化フローで対応可能

- 調査レポートの自動制作:データ分析結果を骨子化し、レポートとしてスライド化

- 営業資料・提案書の自動制作:クライアントごとにカスタマイズされた資料を高速生成

- 社内研修教材の自動制作:社内ナレッジを構造化された教材に変換

- 採用向け会社紹介資料の制作:採用ペルソナごとに異なる訴求軸の資料を量産

運用ノウハウとピットフォール

運用上の工夫

- 既存資産(セミナー動画、ブログ記事、支援事例)を事前に構造化してアクセスしやすくしておく

- 骨子形成のフェーズで「ホワイトペーパーの目的」「読者の意思決定段階」を明確化し、構成の軸をブレさせない

- デザインシステムにスライド固有のコンポーネント(表紙、目次、章扉、本文、CTA等)を事前定義

- 公開後のDL数・CV率を継続モニタリングし、骨子設計にフィードバック

陥りがちな失敗

- 既存資産をそのまま流用しすぎて、独自性の薄い「焼き直し資料」になる → 壁打ちフェーズで「このホワイトペーパー独自の主張」を必ず明文化

- スライド化を急ぎすぎて、骨子の品質が浅いまま量産してしまう → 骨子段階で十分に磨いてからデザイン化に進む運用ルール

- 数値・出典・固有名詞の確認をスキップすると、ブランド毀損リスク → 必ず人間による最終編集+チェックを必須化

事例 A-7:セミナースライド制作の自動化

セミナーのテーマだけ決まった状態から、Claudeとの壁打ちで台本とスライドを同時並行で生成し、30分程度で公開可能なセミナースライド一式を完成させる事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 02. コンテンツマーケティング |

| 実装形態 | AIワークフロー(Claudeチャット+Claude designの2段構成、台本+スライド並行生成設計) |

業務概要

セミナー登壇・ウェビナーで使うスライド資料の制作業務。テーマだけ決まった段階から、Claudeとの壁打ちで「セミナー台本」と「スライド」を並行して設計・制作し、本番公開可能な状態まで一気通貫で完成させる。

Before:AI化前の課題

セミナースライド制作は、ホワイトペーパー以上に「話し物」としての設計が必要で、組織として長らくボトルネックになっていました。

- セミナー1回あたりのスライド枚数が多く(30〜80枚規模)、デザイナーへのアサインが必須

- 内製でも数日〜1週間かかり、登壇者の準備工数も合わせると組織への負担が大きい

- スライドと台本がバラバラに作られ、本番で「スライドと話す内容がズレる」「ページの切れ目で話が不自然になる」問題が頻発

- ベテラン登壇者の暗黙知(どのスライドでどう話すか)が文書化されておらず、若手への引き継ぎが困難

- 結果として、セミナー開催頻度が月1〜2回が限界となり、リード獲得や認知拡大の機会を逃していた

アプローチ

セミナースライド制作の本質的な特徴は「台本とスライドが一体である」ことです。読み物として完結するホワイトペーパー(事例A-6)とは異なり、セミナーは登壇者の話と画面表示が同期して初めて伝わります。

そのため、テーマだけ決まった段階から、Claudeとの壁打ちで台本とスライドを同時並行で生成する設計にしました。

特徴は3点。

- 台本・スライドの並行生成:「このスライドではこう話す」という登壇シナリオと、画面表示するスライドを、同じ壁打ちフローで同時に組み立てる

- 既存資産の構造的活用:A-6と同様、過去のセミナー動画、公開済みブログ記事、支援事例データをClaudeに渡してオリジナル骨子を生成。「読み物」ではなく「話し物」として再構成する

- デザインシステムによる品質安定化:Claude designに事前構築したデザインシステムを参照させ、1スライド1メッセージの原則を守った見やすいスライドを瞬時に生成

仕組みの解説

[Step 1] Claudeチャットでテーマ・ペルソナ整理

- セミナーテーマ・ターゲット聴衆・狙うアクション(CV)を確定

- 想定セミナー時間と全体構成を仮組み

↓

[Step 2] Claudeチャットで台本+骨子の並行生成

- 過去のセミナー動画文字起こし、公開済みブログ記事、

支援事例データ等の社内資産をClaudeに渡す

- 「このスライドではこれを話す」という台本と

「このスライドではこれを表示する」という骨子を

同時に組み立てる

- 各スライドの想定所要時間も同時設計

↓

[Step 3] Claude designでスライド作成

- 骨子をベースに、事前構築したデザインシステムを参照

- 1スライド1メッセージの原則を守って生成

- ブランドトンマナを維持

↓

[Step 4] 人間による最終編集+リハーサル

- 登壇者がスライドを見ながら台本を読み合わせ

- 不自然な切れ目・話の流れを微調整

- 数値・固有名詞の最終確認

↓

[出力] 公開可能なセミナースライド+台本一式使用ツール:Claude(テーマ整理、台本+骨子並行生成、壁打ち)、Claude design(スライド生成、デザインシステム参照)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1セミナースライド制作期間 | 数日〜1週間 | 30分程度 | 大幅短縮 |

| デザイナーのアサイン要否 | 必須 | 不要(マーケター・登壇者単独で完結) | — |

| 台本とスライドの整合性 | バラバラに作るためズレが発生 | 並行生成で完全に整合 | — |

| 月間開催可能セミナー数 | 月1〜2回が限界 | 週次開催も対応可能 | 大幅増加 |

| 登壇者間のナレッジ共有 | ベテランの暗黙知に依存 | 台本付きスライドが組織資産化 | — |

| ブランドトンマナの一貫性 | デザイナー個別判断 | デザインシステムで自動担保 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- セミナー・ウェビナーをリード獲得や認知拡大の主要施策として活用したい

- 社内にセミナー動画・ブログ記事・支援事例等の情報資産が蓄積されている

- 複数の登壇者が異なるテーマで継続的に登壇している

- ブランドガイドラインがある程度言語化されている

注意が必要な組織

- 登壇者個人のスタイルが強く、テンプレ化に向かないテーマ

- 社内資産が構造化されておらず、Claudeに渡せる素材が乏しい

- ライブ感やインタラクション重視のセミナー(事前準備よりアドリブ重視)

横展開のヒント

- 営業向けピッチ資料の制作:ターゲットに応じて台本+スライドを並行生成

- 社内研修教材の制作:研修テーマから台本+教材スライドを同時設計

- 採用説明会資料の制作:採用ペルソナごとに異なる訴求軸の説明会資料を量産

- 動画コンテンツのスクリプト+画面構成:YouTube動画やショート動画の台本+字幕・画面切替設計

- ポッドキャストの台本+ショーノート:音声コンテンツでも「話す台本」と「公開する要約」の並行生成が可能

運用ノウハウとピットフォール

運用上の工夫

- セミナー全体の時間配分(イントロ◯分、本論◯分、Q&A◯分等)を事前にClaudeに伝えると、各スライドの想定所要時間まで設計できる

- 「1スライド1メッセージ」の原則をプロンプトに明示し、情報過密スライドを防ぐ

- 過去に高評価だったセミナー構成を「成功パターンライブラリ」として蓄積、再利用

- リハーサルで違和感のあった箇所は、Claudeに戻して台本・スライド両方を同時修正

陥りがちな失敗

- 台本とスライドを別々に作ろうとすると、本番でズレが発生 → 必ず並行生成の設計フローを守る

- 既存資産をそのまま流用しすぎて、ホワイトペーパー的な「読み物」になってしまう → 「話し物」としての構造化(1スライド1メッセージ、聞き手の集中力曲線への配慮)を意識

- スライド枚数を増やしすぎる → 想定時間×1〜2枚/分を目安にスライド数を制御

- 登壇者本人がリハーサルを省略すると、当日に話のテンポが合わない → リハーサル+微調整は必須プロセス化

Category B|SEO・被リンク獲得(5事例)

サイト内の構造最適化と、被リンク獲得活動の自動化で、SEO評価の土台を強化する5事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| B-1 | キーワードリスト作成の自動化 | 1サイトあたり 10数時間 → 30分程度(約95%削減)/検索意図整理+クラスター設計+CV先+スケジュールまで一気通貫 |

| B-2 | テクニカルSEO分析→改善実装の自動化 | 大規模DBサイトの監査 数十時間 → 大幅短縮/エンジニア不要でSEOディレクター単独完結 |

| B-3 | 内部リンク最適化の自動化 | 1,000ページ分析 1〜2週間 → 数時間/月間処理サイト数 1〜2 → 10サイト以上(10倍) |

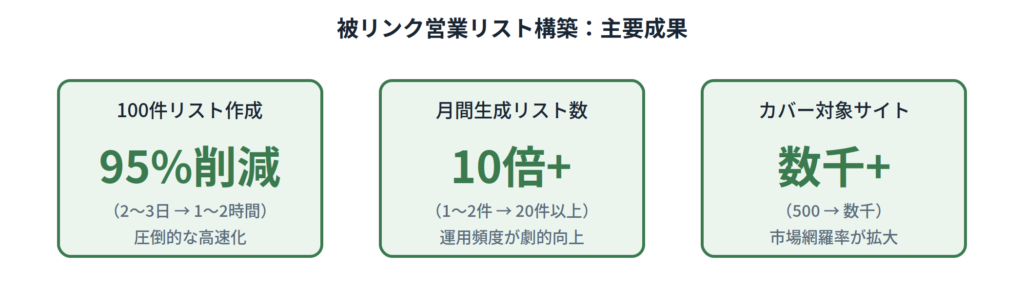

| B-4 | 被リンク営業リスト構築の自動化 | 100件リスト作成 2〜3日 → 1〜2時間(約95%削減)/月間生成リスト数 10倍以上 |

| B-5 | 被リンク営業文生成の自動化 | 1件生成時間 10〜20分 → 1〜2分(約90%削減)/返信率 3〜5倍(テンプレ→パーソナライズ) |

SEOで成果を出すには、戦略の起点となる「キーワードリスト設計」、サイト内の構造化(内部リンク・テクニカル改善)、外部からの評価獲得(被リンク)という3つの軸が必要です。本カテゴリーでは、その3軸をAI化する5事例を紹介します。

事例 B-1:キーワードリスト作成の自動化

検索意図整理・トピッククラスター設計・コンバージョン先設計まで含めたキーワードリスト作成を、人手の10数時間から30分程度まで短縮した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 03. SEO・LLMO |

| 実装形態 | AIワークフロー(Claude+Ahrefs MCP連携) |

業務概要

オウンドメディア立ち上げや拡張時の、SEO観点でのキーワードリスト作成業務。検索意図ベースの整理、トピッククラスター(ピラー+クラスター)設計、コンバージョン先商材の割り当て、コンテンツ制作スケジュール化まで一気通貫で実施する。

Before:AI化前の課題

キーワードリスト作成は、SEO戦略の起点となる最重要工程ですが、人手で行うと膨大な時間がかかる業務でした。

- ツールでキーワード一覧を洗い出すのはスピーディだが、それを検索意図ごとに整理するのが大変。整理しないと記事間でカニバリ(共喰い)が発生してしまう

- ビジネスカテゴリーによっては、洗い出し段階で10数万件のキーワードが出る。これを人力で整理するのに膨大な時間が必要

- ピラーページとクラスターページの関係性整理・内部リンク整理にも、人力で多くの時間がかかっていた

- 商材が複数あるサイトでは、キーワード毎にコンバージョン先商材を設定する作業も人手で実施していたため、さらに工数が膨らんでいた

- 結果として、1サイトのキーワードリスト作成に10数時間を要し、SEO戦略の立ち上げスピードがボトルネック化していた

アプローチ

ClaudeとAhrefsをMCP接続し、ビジネス情報を伝えるだけで、キーワード洗い出しから検索意図整理・クラスター設計・コンバージョン先設計・スケジュール化までを一気通貫で処理するワークフローを構築。

特徴は3点。

- MCP連携によるデータ取得自動化:Ahrefs MCPでキーワードボリューム・KD(キーワード難易度)等を自動取得

- 検索意図ベースの整理を機械処理化:10数万件規模のキーワードでも、Claudeが意図カテゴリーに自動分類

- トピッククラスター構造とコンバージョン設計を統合:ピラーとクラスターのツリー構造、各KWのCV先商材、制作スケジュールまで一貫して設計

仕組みの解説

[Step 0] ClaudeとAhrefsをMCP接続

↓

[Step 1] ビジネス情報をClaudeに伝達

- 商材ラインナップ・ターゲット・競合・既存資産

- ブランドトーン・コンバージョン目標

↓

[Step 2] キーワードの洗い出し

- Ahrefs MCP経由で関連KW群を取得

- ビジネスカテゴリーによっては10数万件規模

↓

[Step 3] 検索意図ベースの整理

- 顕在・潜在・指名・比較・購買意図でグルーピング

- カニバリ回避のため、意図単位で1記事1意図を担保

↓

[Step 4] ボリューム・難易度等のデータ抽出

- 月間検索量、KD、CPC、SERP特徴を統合

↓

[Step 5] トピッククラスター用ツリー図作成

- ピラー(大型KW)とクラスター(派生KW)の関係を構造化

- 内部リンク設計を同時に出力

↓

[Step 6] コンバージョン先商材の設計

- 各KWに対し、最適なCV先商材を自動割り当て

- 商材が複数あるサイトでも一括処理

↓

[Step 7] コンテンツ制作スケジュール化

- 優先度スコアリング(KD・ボリューム・CV近接度)

- 月次・四半期単位の制作計画を生成

↓

[Step 8] 人間による壁打ち精度向上

- マーケターがClaudeと対話しながら最終調整

- ビジネス勘所を反映

↓

[出力] キーワードリスト(検索意図整理・クラスター構造・CV先・スケジュール込み)使用ツール:Claude(戦略設計、整理、壁打ち)、Ahrefs MCP(キーワード抽出、ボリューム・KD・CPC等のデータ取得)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1サイトあたり作成時間 | 10数時間 | 30分程度 | 約95%削減 |

| 検索意図整理の工数 | 数時間〜半日(10数万件規模) | 数分〜10分 | 大幅短縮 |

| トピッククラスター・内部リンク設計工数 | 数時間 | ほぼゼロ(自動生成) | 大幅削減 |

| 商材ごとのCV先設定 | 商材数×数十分 | 数分(自動割り当て) | 大幅短縮 |

| キーワードのカバー範囲 | 担当者の知識・経験に依存 | Claudeとの壁打ちで漏れを補完 | 網羅性向上 |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- オウンドメディアを新規立ち上げ・大幅拡張するフェーズの組織

- 商材ラインナップが複数あり、KWごとのCV先設計が必要なサイト

- 数千〜数十万キーワード規模のビジネスカテゴリーで運用している

- SEO戦略の立ち上げスピードを上げたい組織

注意が必要な組織

- 商材・ビジネスモデルが完全な独自業態で、Claudeが事前知識を持たない

- ビジネス情報・ブランドガイドラインが言語化されていない

横展開のヒント

- 広告KW群の設計:リスティング広告のKWリスト作成、マッチタイプ設計

- 競合KWマップの構築:競合がランクインしているKWの自社流入機会発見

- 多言語版KWリスト作成:1サイトのKW戦略から多言語版を派生

- ECサイトの商品カテゴリー設計:KW分析から商品分類・サイト構造を逆算

- クライアント案件のSEO戦略立ち上げ:シュワットのSEOコンサル業務での活用

運用ノウハウとピットフォール

運用上の工夫

- ビジネス情報のフォーマットを構造化(商材一覧、ターゲット、競合、独自価値)してClaudeに渡すと、整理精度が高まる

- 検索意図カテゴリーの定義(顕在・潜在・指名・比較・購買意図)を事前にプロンプト化し、整理基準を統一

- Ahrefs MCPで取得したデータの解釈基準(KD何以下を「取りやすい」と見るか等)をプロンプトに明示

- 出力されたリストを「即実行版」と「中長期検討版」に分け、優先順位を明確化

陥りがちな失敗

- ビジネス情報の伝達が浅いと、検索意図の判定精度が下がる → 商材・ターゲット・既存資産を必ず構造化して渡す

- ツール任せで人間の壁打ちを省くと、ビジネス勘所が反映されない → 最終調整は必ずマーケターが対話しながら実施

- カニバリ回避を徹底しないと、1記事1意図の原則が崩れ、結果的にSEO評価が分散 → 検索意図単位での1記事マッピングを必須ルール化

事例 B-2:テクニカルSEO分析→改善実装の自動化

業界でも限られた人材しかまともにできなかったテクニカルSEOの監査・分析・改善実装を、SEOディレクター単独で一気通貫で完結させる事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 03. SEO・LLMO |

| 実装形態 | AIエージェント+AIワークフロー(Ahrefs+Claude+Claude Codeのハイブリッド構成) |

業務概要

サイトのテクニカルSEO要素(メタタグ最適化、内部リンク構造、リンク切れ、構造化データ、サイト構造、パフォーマンス等)を監査・分析し、優先順位付けされた改善リストを作成、さらに実装まで一気通貫で実施する業務。

Before:AI化前の課題

テクニカルSEOは、SEO施策の中で最も専門性が要求される領域でありながら、組織のボトルネックとして長らく放置されてきた業務でした。

- 高度な専門知識が必須:業界でも限られた人材しかまともにできず、人的リソース確保自体が難しい

- サイト監査が手作業で膨大な時間:サイト規模に応じて数時間〜大規模DBサイトだと数十時間

- 機械的監査の限界:リンク切れ等はAhrefs等で一括検出可能だが、「重要タグにメインキーワードが含まれているか」「重要ページに内部リンクが向けられているか」など、サイトのビジネスモデル理解が必要な部分は機械的監査では不可能で、人間が手作業で行うしかなかった

- 分析後の実装でエンジニア依存:分析が終わっても、改修実装にはエンジニアのアサインが必須で、そこで再度ボトルネック化

- 結果として、テクニカルSEOは「やるべきと分かっているが、専門家不足と工数面で手をつけられない」状態が常態化していた

アプローチ

テクニカルSEO業務を以下の3フェーズに分解し、それぞれの最適な実装形態でAI化。

- 機械的監査 → Ahrefsで一括処理(リンク切れ・パフォーマンス・基本的な構造)

- 戦略的判断を伴う監査 → AIエージェントが自律的に判断(重要タグの最適化判定、重要ページへの内部リンク優先度判定等)

- 実装フェーズ → Claude Codeで直接コード修正、エンジニア不要

特に重要なのは、フェーズ2「戦略的判断を伴う監査」の自動化です。サイトのビジネスモデル・KPI・優先ページを戦略としてAIエージェントに理解させることで、これまで人間しかできなかった意味理解の監査が自動化できるようになりました。

仕組みの解説

[Step 0] サイトのビジネスモデル・戦略をAIエージェントに伝達

- 重要ページ(CV直結ページ等)の優先度

- メインキーワードと意味的関連性

- ターゲットユーザー像

↓

[Step 1] Ahrefs+ClaudeでAI監査

- 機械的な監査項目はAhrefsで一括処理

(リンク切れ、ステータスコード、表示速度等)

- 戦略的判断が必要な項目は、AIエージェントが自律的に判定

(重要タグへのメインKW包含、重要ページへの内部リンク誘導、

構造化データの妥当性、見出し階層の整合性等)

↓

[Step 2] 課題の洗い出し&優先度設計

- SEOインパクト × 実装難易度でスコアリング

- 優先順位付きリストを瞬時に生成

↓

[Step 3] Claude Codeで実装

- 修正案を直接コードに反映

- メタタグ・構造化データ・内部リンク等の改修

- エンジニア不要、SEOディレクター単独で対応可能

↓

[出力] 改善済みサイト+実施ログ使用ツール:Ahrefs(機械的な監査項目)、Claude(AIエージェント:戦略理解と意味的判断を伴う監査)、Claude Code(実装・コード修正)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| サイト監査時間 | 数時間〜数十時間(大規模DBサイト) | 短時間で完了 | 大幅短縮 |

| 必要なスキルセット | 業界でも限られた専門人材 | SEOディレクター+AI活用スキル | 民主化 |

| 戦略的監査の自動化率 | ほぼゼロ(人間の手作業) | 戦略を伝えれば自律判断 | — |

| 実装フェーズの担い手 | エンジニアのアサインが必須 | SEOディレクター単独で完結 | — |

| 改善優先順位の設計 | 担当者の経験に依存 | スコアリングで一貫した判断 | — |

| プロジェクト全体の所要時間 | 数週間〜数ヶ月(人材調整含む) | 大幅短縮 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- 中〜大規模サイト運営(特にDB型サイトでテクニカル課題が累積している)

- SEO流入が事業KPIに直結する

- これまでテクニカルSEOの専門人材確保に苦労していた

- 「分析はできても実装で止まる」というボトルネックを抱えている

- エンジニアリソースを他の優先業務に集中させたい

注意が必要な組織

- サイトのビジネスモデル・戦略が明文化されておらず、AIに渡せない

- 独自CMSや特殊な構成で、Claude Codeでの修正が困難な環境

- 重大な構造変更が必要なケース(この場合は別途エンジニアとの協業を推奨)

横展開のヒント

- 大規模サイトリニューアル時の事前監査:リニューアル前のテクニカル課題を網羅的に洗い出し

- 競合サイトのテクニカル分析:ベンチマーク調査として競合のテクニカル実装を解析

- クライアント案件のSEOコンサル業務:シュワットのSEOコンサル業務での標準フロー化

- アクセシビリティ監査:類似のスキーマで、a11y要件への準拠度監査

- LLMO観点の構造化監査:AI検索エンジンに引用されやすい構造の検証

- 多サイト運営企業の横串監査:複数サイトを一括で監査・改善

運用ノウハウとピットフォール

運用上の工夫

- 戦略情報をAIエージェントに渡す際の構造化テンプレート(重要ページ・メインKW・ターゲット)を事前整備

- 監査項目をチェックリスト化(テクニカルSEOの100項目チェックなど)し、毎月の定期監査として組み込む

- 改善実装後のSEO評価変化を追跡し、施策効果のフィードバックループを構築

- 「機械的監査で済む項目」と「戦略判断が必要な項目」を明確に分け、Ahrefs/AIエージェントで使い分け

- 大規模変更時は必ずステージング環境で検証してから本番反映

陥りがちな失敗

- 戦略情報の伝達が浅いと、AIエージェントの判断精度が下がる → ビジネスモデル・優先ページ・KGIを必ず構造化して渡す

- AIの判断を盲信して人間レビューを省くと、ブランド一貫性や独自要件で問題が出る → 重要な変更は必ず人間が承認

- 改善実装を急ぎすぎてバックアップを取らない → 必ず変更前の状態を保存し、即時ロールバック可能な体制

- 監査結果の優先度設計をスキップすると、リソース分散で効果が出ない → SEOインパクト×実装難易度でのスコアリングを必須ルール化

事例 B-3:内部リンク最適化の自動化

大規模サイトの全ページを分析し、SEO効果を最大化する内部リンク追加候補を自動生成するAIワークフローの事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 03. SEO・LLMO |

| 実装形態 | AIワークフロー(パイプライン型) |

業務概要

サイト全体の内部リンク構造を分析し、SEO効果を最大化するためのリンク追加・修正案を自動生成する業務。

Before:AI化前の課題

内部リンク最適化は、SEOの基礎施策でありながら、大規模サイトでは実務的に困難でした。

- 1,000ページを超えるサイトでは、人手で全体構造を把握することが不可能

- 「どのページからどのページへ」という最適なリンクの判断は、コンテンツの意味理解が必要

- リンク追加の工数が膨大で、優先順位付けも難しい

結果として、「内部リンクが重要なのは知っているが、手をつけられない」という状況が続いていました。

アプローチ

サイト全体を俯瞰し、ページ間の意味的関連性をベクトル化して分析。SEO的に効果的なリンク追加候補を、優先順位付きで自動生成するワークフローを構築しました。

仕組みの解説

[入力] サイトURL(クロール対象)

↓

[Step 1] 全ページのクロールとコンテンツ取得

↓

[Step 2] 各ページの意味ベクトル化(埋め込み生成)

↓

[Step 3] 既存内部リンク構造の解析

↓

[Step 4] ページ間の意味類似度マトリクス生成

↓

[Step 5] 「リンクすべきだが、まだリンクされていない」ペアの抽出

↓

[Step 6] 各候補に対する優先度スコアリング

(ページの重要度 × 関連性 × アンカーテキスト適合性)

↓

[Step 7] アンカーテキスト案の生成

↓

[出力] リンク追加候補リスト(優先度順、CMS反映用形式)After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1,000ページの分析時間 | 1〜2週間(人手) | 数時間 | 大幅短縮 |

| 提案精度 | 担当者依存 | データ駆動で一貫 | — |

| 月間処理可能サイト数 | 1〜2サイト | 10サイト以上 | 10倍 |

| 抜け漏れリスク | 中〜高 | ほぼゼロ | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に有効な組織:

- 大規模サイト運営(500ページ以上)

- SEO流入が事業KPIに重要

- 複数のテーマクラスターを持つコンテンツ構造

注意が必要な組織:

- 数ページしかないコーポレートサイト(適用効果が小さい)

- 内部リンクよりも被リンク獲得が課題のフェーズ

横展開のヒント

- ECサイトの関連商品レコメンド最適化(商品ページ間の意味的関連を活用)

- ヘルプセンターの導線改善(FAQ間の関連性に基づく誘導)

- ナレッジベースの構造化(社内Wiki等の関連記事サジェスト)

運用ノウハウとピットフォール

運用上の工夫:

- リンク密度の上限設定(過剰リンクによるユーザー体験劣化を防止)

- 「孤立ページ」(被リンクゼロ)の優先発見モード

- アンカーテキストの多様性確保(同じテキスト連発を回避)

陥りがちな失敗:

- 機械的にリンクを追加しすぎる → ページあたり追加リンク数の上限設定

- アンカーテキストが不自然 → 文脈を読み取って自然な文言を生成

- リンク先ページの品質を考慮しない → リンク先ページの品質スコアもフィルター条件に

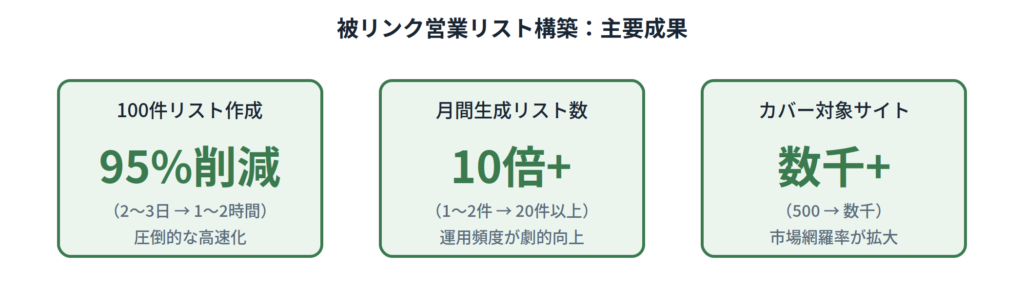

事例 B-4:被リンク営業リスト構築の自動化

被リンク営業先を自律的に発掘・評価するAIエージェントで、リスト作成工数を95%削減した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 03. SEO・LLMO |

| 実装形態 | AIエージェント |

業務概要

自社サイトに被リンクを貼ってくれる可能性が高いサイトを、自律的に発掘・評価し、優先順位付けされた営業対象リストを生成する業務。

Before:AI化前の課題

被リンク獲得は、SEOにおいて最重要かつ最困難な施策です。問題は3つでした。

- 営業対象サイトの発掘が、担当者の知識・経験に大きく依存

- 各サイトの評価(ドメイン評価、関連性、貼ってもらえる可能性)の判断が属人的

- 100件のリスト作成に2〜3日を要し、月に1〜2回しか実施できない

特に「関連性は高いが、まだ自社が認知していないサイト」の発掘が大きなボトルネックでした。

アプローチ

「営業対象サイト発掘」というタスクは、固定手順では処理できません。検索結果の評価、関連サイトのトラバース、ドメイン評価、コンテンツ分析、判断——多くの分岐と探索が必要です。

そのため、自律的に判断・行動するAIエージェントとして実装することにしました。

仕組みの解説

[入力] ターゲットキーワード(例:「マーケティング AI」)

↓

[エージェントの自律行動]

- 関連検索結果の取得・分析

- 上位サイトの構造分析

- 関連サイトへのリンクトラバース

- 各サイトのドメイン評価取得

- コンテンツ関連性の評価

- 「リンク提供してくれる可能性」の予測

- 必要に応じて追加検索を自律実行

↓

[出力] スコアリング済み営業対象リスト

- サイト名・URL

- ドメイン評価

- 関連性スコア

- 推奨アプローチ方法

- 担当者連絡先(特定可能な場合)エージェントは、ゴール(「100件の高品質リスト」)を達成するため、必要に応じて検索・分析・絞込みを反復します。

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 100件リスト作成時間 | 2〜3日 | 1〜2時間 | 約95%削減 |

| 評価基準の一貫性 | 担当者によりばらつき | 完全に統一 | — |

| 月間生成リスト数 | 1〜2件 | 20件以上 | 10倍以上 |

| カバー対象サイト数 | 〜500 | 数千〜 | 大幅拡大 |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織:

- BtoB SaaS、メディア運営、専門サービス業(被リンク重要度高)

- 自社で被リンク営業を継続的に行っている

- 営業対象市場が広く、人手では網羅困難

横展開のヒント

- PR・メディアアプローチリスト構築(プレスリリース送付先の自動発掘)

- インフルエンサーマッチング(自社ブランドと相性のいい発信者の発見)

- 採用候補者リスト構築(技術ブログ等から人材発掘)

運用ノウハウとピットフォール

運用上の工夫:

- 「過去にコンタクト済み」リストとの自動突合(重複アプローチ防止)

- 業界・規模・地域でのフィルター機能

- ドメイン評価の継続モニタリング(評価変動を検知)

陥りがちな失敗:

- ドメイン評価のみで判断すると、関連性が低いリストになる → 関連性スコアを必須評価軸に

- エージェントの探索範囲が無制限になり、コストが膨らむ → 探索深度・時間の上限設定

- 営業先の品質が時間とともに低下する → 過去の成功率データをフィードバックループに

事例 B-5:被リンク営業文生成の自動化

相手サイトの文脈に合わせたパーソナライズ営業文を、AIワークフローで自動生成し、返信率を3〜5倍に高めた事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 03. SEO・LLMO |

| 実装形態 | AIワークフロー |

業務概要

「被リンク営業リスト構築の自動化」事例で生成した営業対象リストの各サイトに対し、相手の文脈に合わせた営業文を自動生成する業務。

Before:AI化前の課題

被リンク営業の成否は、テンプレ的な営業文か、相手の文脈に踏み込んだパーソナライズ文かで、返信率が10倍以上変わります。しかし:

- 1件あたり「相手サイトを読み込み、関係性を見出し、営業文を書く」という工程を行うと10〜20分かかる

- 100件送るには16〜33時間が必要、現実的ではない

- テンプレ文の使い回しは返信率が極端に低い

結果として、「営業リストはあるのに、送れない」状況が続いていました。

アプローチ

各営業対象サイトのコンテンツを読み込み、相手の関心領域や最近の発信内容に紐づけた営業文を自動生成するワークフローを実装しました。

仕組みの解説

[入力] 営業対象リスト(「被リンク営業リスト構築の自動化」事例の出力)

↓

[各サイトに対し並列実行]

↓

[Step 1] 相手サイトのトップページ・最新記事を取得

[Step 2] 相手の関心テーマ・最近のトピックを抽出

[Step 3] 自社コンテンツとの関連性ポイント特定

[Step 4] パーソナライズ営業文を生成

- 冒頭:相手の最新発信に言及

- 中盤:自社コンテンツの紹介と、なぜ相手の読者に有益か

- 結び:相互ベネフィットを明示した提案

[Step 5] 担当者承認用のダイジェストに整形

↓

[出力] 営業文ドラフト(送信前承認待ち)After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1件あたり生成時間 | 10〜20分 | 1〜2分 | 約90%削減 |

| 月間送信可能件数 | 30〜50件 | 500件以上 | 10倍以上 |

| 返信率(パーソナライズ vs テンプレ) | 1〜3%(テンプレ) | 8〜15%(パーソナライズ) | 3〜5倍 |

| 被リンク獲得月次本数 | 1〜3本 | 10〜30本 | 大幅増加 |

※社内運用の参考値。条件により変動します。

適用範囲

すべての被リンク獲得を行っている組織で再現可能。特にBtoB SaaS、メディア、専門サービス業で高ROI。

横展開のヒント

- 営業メールのパーソナライズ(BtoB営業のコールド営業文の自動生成)

- PR・取材依頼のパーソナライズ(メディア記者への取材依頼文の自動生成)

- 採用スカウトのパーソナライズ(候補者の発信内容に合わせたスカウト文)

運用ノウハウとピットフォール

運用上の工夫:

- 営業文の効果測定(送信→返信→リンク獲得)と継続学習

- 相手の業界・規模ごとに営業文テンプレートを最適化

- 送信間隔の調整機能(同一ドメイン内に集中送信しない)

陥りがちな失敗:

- パーソナライズが浅く、結局テンプレと変わらない → 相手の最新記事を必ず読み込み、具体的な言及を含める

- 自社の宣伝に偏った営業文になる → 「相手にとってのベネフィット」を主軸にする設計

- スパム判定リスク → 送信頻度・件数のコントロールと、自然な文章への配慮

Category C|LP制作・改善(3事例)

LPの一括生成・新規個別制作・公開後改善を、マーケター単独で完結させる3事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| C-1 | サービスLP一括生成の自動化 | 1LP工数 3〜5日 → 数時間(約85%削減)/月間生成LP数 5〜10倍 |

| C-2 | 新規LP制作の一気通貫自動化 | 制作期間 1ヶ月以上 → 3〜4時間(約99%削減)/関与人数 3名以上 → マーケター1名 |

| C-3 | LPO(LP改善)の自動化 | 実装期間 1週間〜1ヶ月 → 10分〜1時間/Meta広告CPA −40% の実績 |

LP制作はマーケティングの中で最も多くの専門職(マーケ・デザイナー・コーダー)が関わる業務であり、組織のボトルネックになりがちです。本カテゴリーでは、LP関連業務のフルライフサイクル(生成・新規制作・改善)をAI化する3事例を紹介します。

なお、AIを使ったLP作成については下記の記事でも詳しく解説しています。

事例 C-1:サービスLP一括生成の自動化

サービス情報とブランドガイドラインから、ランディングページを一括生成するAIワークフローで、1LPあたり工数を85%削減した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 10. Webサイト・LP制作 |

| 実装形態 | AIワークフロー |

業務概要

自社サービス、または派生サービスのランディングページを、ヒアリング情報・既存資料・ブランドガイドラインから自動生成する業務。

Before:AI化前の課題

サービスLPの制作は、複数のサービス・派生サービスを持つ企業にとって慢性的なボトルネックでした。

- 1LPあたり「企画→構成→ライティング→デザイン指示→公開」で3〜5日

- 複数サービスの横展開時、各サービス用LPの量産が間に合わない

- ブランドトンマナの一貫性維持が、担当者交代で崩れがち

- 多言語展開時、さらに工数が膨らむ

結果として、「サービスはあるのに、LPがない/古い」状況が長期化していました。

アプローチ

LP制作のすべての工程を分解し、AIで処理可能な領域を特定。ブランドガイドラインを学習データとして組み込んだワークフローを構築しました。

仕組みの解説

[入力] サービス情報(名称、概要、ターゲット、特徴、競合、料金)

↓

[Step 1] ペルソナ・課題マップの自動生成

[Step 2] ストーリーフロー設計(PASONA, AIDMA等のフレーム適用)

[Step 3] セクション構成の決定

[Step 4] 各セクションのコピーライティング

- ヘッドライン

- サブヘッド

- ボディコピー

- CTA

[Step 5] ブランドトンマナ準拠チェック・自動補正

[Step 6] 構造化されたLPコンテンツ出力

[Step 7] CMS or デザインツールへの引き渡し

↓

[出力] LP原稿一式(編集者承認待ち)After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1LPあたり工数 | 3〜5日 | 数時間 | 約85%削減 |

| 月間生成可能LP数 | 1〜2本 | 10本以上 | 5〜10倍 |

| トンマナの一貫性 | 担当者依存 | ブランドガイドライン自動遵守 | — |

| 多言語展開 | 別途工数発生 | 同フローで対応可 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織:

- 複数サービス・派生サービスを持つBtoB/BtoC企業

- セミナー・キャンペーンLPを高頻度で制作

- 多言語展開を推進中の企業

横展開のヒント

- 採用LPの自動生成(職種別・ポジション別の採用ページ量産)

- イベント・ウェビナーLP(頻繁な開催への対応)

- 製品比較ページ(競合との比較LPを自動生成)

- 多言語展開(1つのLPから多言語版を一括生成)

運用ノウハウとピットフォール

運用上の工夫:

- ブランドトンマナガイドラインを構造化データとして整備し、AIに学習させる

- 過去に高CVRだったLP構成を「成功パターンライブラリ」として蓄積

- 競合LPの構成分析を組み込み、差別化ポイントを自動提案

陥りがちな失敗:

- AI生成原稿のままだと「無難で目立たない」LPになりがち → 必ず人間の編集者がブランド独自の主張を強化

- ペルソナが浅いと、刺さらないLPになる → 入力時のペルソナ情報の精度が成否を分ける

- A/Bテストせずに本番投入 → 必ずトラフィックを2〜3パターンに分けて効果測定

事例 C-2:新規LP制作の一気通貫自動化

これまで複数名で1ヶ月以上かかっていた新規LP制作を、マーケター1名・3〜4時間で本番公開まで完結させる事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 10. CRO・UX・サイト改善 / 02. コンテンツマーケティング |

| 実装形態 | AIワークフロー(Claudeチャット+Claude design+Claude Codeの3段構成) |

業務概要

マーケターが企画・コピーライティングからデザイン制作、本番公開まで、デザイナー・コーダー不要で1人で完結させる、新規LP制作の一気通貫自動化。

Before:AI化前の課題

新規LP制作は、複数の専門職が関わるため、組織として最も工数がかかる業務の1つでした。

- マーケター(企画・ライティング)+デザイナー(デザイン)+コーダー(実装)で、3名以上の体制が必須

- 制作期間は1ヶ月以上(社内案件、外注時も大差なし)

- 外注時のコストは1LPあたり40〜80万円

- 担当者間の認識ズレ、レビュー往復、トンマナ統一の難しさが慢性的な遅延要因

- マーケターが「LPを作りたい」と思っても、デザイナーとコーダーのアサイン待ちで施策スピードが落ちる

アプローチ

LP制作のすべての工程をAIで処理可能か検証。結果として、マーケター1名×Claudeの3つの機能で完結させる、3段ワークフローを構築。

- 企画・ライティング:Claudeチャットでマーケター本人が壁打ちしながら骨子+コピーを作成

- デザイン生成:Claude designで、事前構築した高度なデザインシステムをベースに自動生成

- 公開:Claude CodeでWordPressへのテスト公開→本番公開を自動化

仕組みの解説

[Step 1] Claudeチャットで企画・ライティング

- マーケターが壁打ちしながら骨子作成

- ペルソナ・ニーズ・勝ち筋を整理

- セクション構成とコピーライティング

↓

[Step 2] Claude designでデザイン生成

- 事前構築済みの高度なデザインシステム(カラー定義、

タイポグラフィ、コンポーネントセット等)を参照

- ブランドのトンマナを維持しながら自動生成

- クオリティの安定化が組み込まれた構造

↓

[Step 3] Claude CodeでWordPress公開

- テスト環境への自動公開

- 内容・表示確認後、本番公開

↓

[出力] 本番公開済みLP事前準備として、ブランド全体である程度デザインが固まっていれば、デザインシステム構築は1〜2時間で完了。一度構築すれば、その後すべてのLP制作で再利用可能です。

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 制作期間 | 1ヶ月以上 | 3〜4時間 | 約99%削減 |

| 関与人数 | マーケ+デザイナー+コーダーの3名以上 | マーケター1名のみ | 3分の1以下 |

| 1LPあたり外注コスト | 40〜80万円 | 社内人件費のみ | 大幅削減 |

| 月間制作可能LP数 | 1〜2本 | 10数本 | 約10倍 |

| トンマナ一貫性 | デザイナー個別判断 | デザインシステムで自動担保 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- ブランドガイドラインがある程度言語化されている

- LPを継続的に量産する必要がある(サービス紹介、キャンペーン、セミナー、採用等)

- マーケ部門に施策スピードと裁量を持たせたい

注意が必要な組織

- ブランドガイドラインが暗黙知に依存し、整理されていない

- LPの本数が年数本程度で、デザインシステム構築の初期投資が回収しにくい

横展開のヒント

- 広告LP・キャンペーンLP:A/Bテスト用のバリエーション量産にも活用可能

- 採用LP:職種別・ポジション別の採用ページを高速制作

- セミナー・ウェビナーLP:頻繁な開催への即応

- 多言語展開:1つのLPから多言語版を一括生成

運用ノウハウとピットフォール

運用上の工夫

- デザインシステムの初期構築に1〜2時間投資する(その後すべてのLPで再利用)

- マーケターが壁打ちで使うプロンプトをテンプレート化し、品質と思考の網羅性を担保

- 過去に高CVRだったLP構成を「成功パターンライブラリ」として蓄積

- テスト公開→本番公開の前に、必ずチームメンバーによる第三者レビューを入れる

陥りがちな失敗

- デザインシステムの整備不足で、Claude designの出力品質が安定しない → 構築時にコンポーネント・スペーシング・タイポグラフィを明示的に定義

- マーケター単独で完結することで、第三者の視点が欠落しブランド独自の主張が薄まる → 公開前のクロスレビューを必須化

- 「速く作れる」ことを優先しすぎてペルソナ設計が浅くなる → 壁打ちの最初のフェーズで必ずペルソナと勝ち筋を明文化

事例 C-3:LPO(LP改善)の自動化

LP改善の施策アイデアから本番公開までを、マーケター単独で1時間以内に完結させ、Meta広告CPA −40%の成果も生んだ事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 10. CRO・UX・サイト改善 / 04. Web広告運用 |

| 実装形態 | AIワークフロー(Claudeチャット+Claude design+Claude Codeの3段構成) |

業務概要

公開済みLPに対する改善施策(セクション追加・デザイン変更・コピー修正等)を、マーケター単独で企画から本番公開まで完結させ、A/Bテストの高速化とCV改善を実現する業務。

Before:AI化前の課題

LP改善は、施策アイデアが出てから実装まで時間がかかりすぎることが、組織の慢性的なボトルネックでした。

- 広告運用成果を改善したい時や、SEOで重要なセクションを追加したい時、マーケターがアイデアを思いついても、デザイナー・エンジニアのアサインが必要だった

- 外注すると数十万円のコストが発生

- 実装まで1週間〜1ヶ月かかり、施策のスピード感が失われる

- A/Bテストのサイクルが遅く、改善PDCAが回らない

- 結果として、「広告のCPAが悪化していてもLPの改善が間に合わない」「SEO観点でセクション追加すべきと分かっていても着手できない」状況が続いていた

アプローチ

LP改善業務をマーケター単独で完結できるよう、Claudeの3つの機能を組み合わせた3段ワークフローを構築。事例 C-2(新規LP制作)と同じ構成を、既存LPの改善に応用しました。

- 改善内容の検討・骨子化:Claudeチャットで壁打ちしながら変更内容を確定

- デザイン生成:既存LPのトンマナ・デザインをClaude designに読み込ませ、ページに溶け込むデザインで改善箇所を生成

- コーディング・公開:Claude Codeでコーディング→本番公開

仕組みの解説

[Step 1] 変更内容を検討

- 広告成果データやSEO観点から、改善したいセクションを特定

- 仮説立て

↓

[Step 2] Claudeチャットで壁打ちしながら変更内容骨子を確定

- 何を変えるか、なぜ変えるか、どう変えるかを明文化

- コピー案・構成案を確定

↓

[Step 3] Claude designでデザイン作成

- 既存LPのトンマナ・デザインを読み込ませる

- ページに溶け込むデザインで改善箇所を生成

- 既存ブランド一貫性を自動的に保持

↓

[Step 4] Claude Codeでコーディング・本番公開

- 既存LPのHTML/CSS構造に統合

- テスト確認後、本番公開

↓

[出力] 改善されたLP(本番公開済み)After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 改善施策の実装期間 | 1週間〜1ヶ月 | 10分〜1時間 | 大幅短縮 |

| 関与人数 | マーケ+デザイナー+エンジニア | マーケター1名のみ | 3分の1以下 |

| 1施策あたり外注コスト | 数十万円 | 社内人件費のみ | 大幅削減 |

| A/Bテストのスピード | 月1〜2回 | 週単位以上 | 数倍 |

| 実績例:Meta広告CPA改善 | — | −40%削減(実績ケース) | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- 公開済みLPで広告運用やSEO流入を獲得している

- A/Bテストを継続的に行いたいが、実装ボトルネックで頻度が上がらない

- マーケ部門に施策スピードと裁量を持たせたい

- 広告CPA・CV率改善を最重要KPIとしている

注意が必要な組織

- LPトラフィックが少なく、A/Bテストの統計的検出力が不足している

- 既存LPのコード構造が複雑で、Claude Codeでの修正が難しい

横展開のヒント

- サービスサイト全体のCRO:個別ページの改善を高速化

- EC商品ページの改善:商品ごとの最適化を高速サイクル化

- メールマガジンのテンプレ改善:開封率・CTR改善のA/Bテスト高速化

- 広告クリエイティブと連動したLP改善:広告 → LP の一気通貫A/Bテスト

運用ノウハウとピットフォール

運用上の工夫

- 改善施策の優先順位スコアリング(広告CPA影響度 × 流入インパクト × 実装コスト)でアイデアを並べ替え

- 「変更内容骨子」のフォーマットをテンプレ化し、壁打ちの思考漏れを防ぐ

- A/Bテストの結果を「成功パターンライブラリ」として蓄積し、横展開可能に

- 既存LPのデザイントークン(カラー、タイポグラフィ、間隔)を構造化し、Claude designに渡す資産化

陥りがちな失敗

- 「速く作れる」ことを優先しすぎて、A/Bテストせずに本番投入 → 必ず統計的有意性を確認するまで結論を保留

- 既存LPのトンマナとズレた改善で、ブランド一貫性が崩れる → 既存デザインシステムを必ずClaude designに読み込ませる

- 短期CV指標のみ追ってブランド価値を毀損 → 長期指標(NPS、ブランドリフト)も並行モニタリング

Category D|SNS運用(1事例)

経営者・キーパーソンの個人SNS発信を、人格・型・品質をドキュメント化することで80%以上自動化する事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| D-1 | X(旧Twitter)個人アカウント運用の自動化 | 1日4〜6時間 → 1日1〜1.5時間(約75〜85%削減)/構築コスト16〜31時間で回収期間1週間以内 |

SNS運用、特に経営者・代表クラスのキーパーソンによる個人発信は、リード獲得・採用ブランディング・業界内ポジショニングに大きく寄与するにもかかわらず、本人の時間制約により形骸化しがちな施策です。「センス」「人脈」「時間」が必要とされる属人的業務とされてきましたが、適切な設計で大幅な自動化が可能になりました。

事例 D-1:X(旧Twitter)個人アカウント運用の自動化

経営者の個人X運用にかかる1日4〜6時間の作業を、人格・型・品質をドキュメント化したAI自動化システムで1日1〜1.5時間に圧縮した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 05. SNS・コミュニティ |

| 実装形態 | AIワークフロー(Claude Code Routines+Claude Project+Slackの統合構成) |

業務概要

経営者・代表クラスの個人Xアカウントを継続運用する業務。情報収集、投稿案生成、引用RT・リプライ案生成、リプライ対応、週次分析までを一気通貫でカバーする。

Before:AI化前の課題

X運用は、フォロワー拡大とリード獲得のため多くの企業の代表・キーパーソンが取り組む施策ですが、以下の課題で形骸化しがちです。

- 毎日の情報収集に1〜2時間(RSS・X・ニュースサイト巡回)

- 投稿文を考えるネタ切れ、1投稿あたり30分〜1時間

- フォロワー増のための他人投稿への引用RT・リプライ巡回に1〜2時間/日

- リプライ対応に30分〜1時間/日

- パフォーマンス分析に週1〜2時間

合計:1日4〜6時間、週28〜42時間が必要で、代表が片手間で行うのは現実的でなく、形骸化するか専属担当者を置くしかなかった。

アプローチ

X運用の全工程を分解し、それぞれに最適なAI実行環境を割り当てる設計。

特徴は4点。

- AIに任せる業務と人が握る業務の役割分離:AIは情報収集・ネタ分類・投稿案生成・エンゲージメント案生成・定型分析。人間は投稿の最終判断・リプライ返信・ブランド一貫性の監視。完全自動化はアルゴリズム的にもブランド的にも逆効果

- 「人格定義書」の事前作成:ペルソナ・トーン・禁止表現・主張を文書化し、すべてのAIプロセスに継承。社員が運用しても本人のキャラが維持される

- 「型」と「品質基準」の体系化:投稿の構造パターン(7種類の型)と品質チェックリストを別ドキュメント化し、すべての投稿に通底させる

- 3つのAI実行環境の使い分け:定期実行→Claude Code Routines、対話型修正→Claude Project、分析・週次レポート→Claude単発実行

仕組みの解説

基盤ドキュメント(4種):すべてのAIプロセスがナレッジとして参照する基盤。

| ドキュメント | 役割 |

|---|---|

| キャラ設計書 | 人格・トーン・一人称・絵文字頻度・禁止表現・立場主張 |

| 型マトリクス | 7つの投稿構造パターン(フック先行/箇条書き/データ+意見/逆張り/ツール組合せ/海外スレッド翻訳/未来予測) |

| 品質チェックリスト | 投稿前必須項目8カテゴリ、24時間モニタリングフロー |

| 巡回先30人リスト | 3レイヤー(マーケ責任者層/AIインフル層/若手層) |

3つのAI実行bot

[朝の情報収集bot](Claude Code Routine)

毎朝7:00 JST

↓

海外プラクティショナーのX投稿、AI実装系ニュースレター、

AI Lab公式から「マーケ×AI 実装事例」を5本収集

↓

Slack #aix-news-feed に出力

[投稿生成bot](Claude Project)

オンデマンド

↓

ニュース・トピック・URLを入力

↓

2〜3案(型・軸・推奨理由つき)を生成

通常投稿/スレッド/長文を自動判定

数字捏造は厳格禁止

[エンゲージメント生成bot](Claude Code Routine ×3)

朝8:00 / 昼13:00 / 夕18:00 JST

↓

巡回先30アカウントの投稿を確認

時間帯別に注力レイヤーを切替

↓

Slack #aix-engagement-drafts に1日10〜15件

[人間レビュー → X実行 → 24時間モニタリング]

リプライは本人が直接返信

(アルゴリズム的に最重要のため)

[週次自動分析]

ダッシュボード自動生成使用ツール:Claude Code Routines(定期実行型のbot)、Claude Project(対話型の投稿生成)、Slack(ドラフト集約と運用本部)、X Premium(投稿実行・分析)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1日あたり工数 | 4〜6時間 | 1〜1.5時間 | 約75〜85%削減 |

| 週次工数 | 28〜42時間 | 7〜10時間 | 約75〜85%削減 |

| 朝の情報収集 | 1〜2時間 | 確認のみ10分 | — |

| 投稿文作成 | 30分〜1時間/投稿 | レビュー15分 | — |

| 巡回・引用RT案出し | 1〜2時間 | 選んで実行15分 | — |

| 質の標準化 | 担当者依存 | 社員運用でもキャラ完璧再現 | — |

| 構築コスト | — | 16〜31時間(1回) | 回収期間1週間以内 |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- B2B SaaS、コンサルティング、AI/テック系スタートアップ、専門サービス業(士業・医療・教育)

- 経営者・代表が個人ブランド構築を志向している

- マーケティング責任者が業界内発信を継続したい

- 発信したい専門領域が明確で、Slack等の社内コミュニケーション環境がある

注意が必要な組織

- 経営者本人が発信に興味なく、片手間ですら時間を割けない

- 発信領域が曖昧で、ターゲット読者が定まっていない

- ライブ感やリアルタイム性が極めて重要な領域(速報メディア等)

横展開のヒント

- LinkedIn個人アカウント運用:基盤ドキュメントの一部差し替えで対応可

- note・ブログ運営:投稿生成botの拡張で記事執筆フローへ

- メールニュースレター:朝の情報収集botを起点とした配信フロー

- 社内ナレッジ共有:基盤ドキュメント×Slackの構造をそのまま転用

- 営業担当者の個別SNS発信代行:個人ごとにキャラ設計書を作成し、同じシステムで複数人運用

- クライアント企業のSNS運用支援:シュワットの支援メニューとして外販可能

運用ノウハウとピットフォール

運用上の工夫

- 「人格定義書」の事前作成が最重要。技術より、ペルソナ・トーン・主張の文書化が成果を決める

- 3層のドラフトレビュー体制(bot生成→Slack整理→X実行)で品質を安定化

- 「型」を継続的に更新。X上の流行を週次で観察し、月次でマトリクスに追加

- アルゴリズム変更への追従。半年に1回は仕組み全体を見直す前提で構築

- bot生成量は1日10〜15件が現実線。多すぎると社員のレビューが追いつかず形骸化

陥りがちな失敗

- AIに任せきる完全自動化 → アルゴリズム的にもブランド的にも逆効果。リプ返信・最終判断は必ず人間

- 数字の捏造(「弊社で30社検証」など未確認データの自動生成)→ システムプロンプトで明示的に禁止

- 人間味の維持を怠る → 完全AIっぽい投稿はフォロワーに見抜かれる。リプ返信・舞台裏共有・失敗談など「人間要素」を意識的に混ぜる

- アルゴリズム変動の見落とし → プラットフォーム側のアルゴリズム変更は頻繁。半年ごとの仕組み見直しを前提化

Category E|広告運用(1事例)

広告クリエイティブの生成・差し替え・改善ループをAIで高速化し、「当たりクリエイティブ」の発掘速度を桁違いに上げる事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| E-1 | 広告クリエイティブ制作の自動化 | 高予算案件でも2ヶ月で50以上のクリエイティブ差し替えを実現/デザイナー外注費・工数を大幅圧縮 |

Meta広告に代表される運用型広告では、「当たりクリエイティブ」の発掘が成果の大半を決定します。理論上は高頻度でクリエイティブを差し替えるほど勝ち素材に出会う確率が上がりますが、実態は人間デザイナーの制作工数・外注費が制約となり、差し替え頻度を上げきれずにいるケースが大半でした。本カテゴリーでは、その制約をAIで解消し、当たり発掘の確率を構造的に高める設計を紹介します。

事例 E-1:広告クリエイティブ制作の自動化

人間デザイナー制作だと工数・外注費の制約で差し替え頻度が伸びきらなかったMeta広告クリエイティブを、Higgsfield MCPとClaudeの組み合わせで高速生成し、高予算案件でも2ヶ月で50以上の差し替えを実現した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 04. Web広告運用 |

| 実装形態 | AIワークフロー(Higgsfield MCP+Claude+Meta Ads MCPの3点構成) |

業務概要

Meta広告(Facebook / Instagram)に代表される運用型広告のクリエイティブ(画像・動画バナー)制作と差し替えを、AIで高速化する業務。当たりクリエイティブの発掘速度を上げ、広告成果(CTR / CVR / ROAS)を改善する。

Before:AI化前の課題

Meta広告の成果は、ターゲティングや入札以上に「クリエイティブの当たり外れ」で決まります。高頻度で差し替えるほど勝ち素材に出会う確率が上がる構造ですが、実態には大きな制約がありました。

- 1バナーあたりの制作に数日〜1週間、デザイナーアサインや外注時はさらに遅延

- 外注時のコストは1セット数万〜数十万円規模

- 結果として、広告予算が高い案件でも差し替え頻度を上げきれないジレンマ

- 「もう少し差し替え頻度を上げれば成果が伸びるはず」と分かっていても、制作リソースが追いつかず実現できない

- 高予算案件ほど「当たりが見つからないまま予算を浪費する」リスクが高まる

- 結果として、本来到達できたはずのCPA・ROASに届かない機会損失が累積していた

アプローチ

「クリエイティブ差し替え頻度」をKPIに据え直し、それを構造的に高めるためのAI活用設計をシュワット社内で構築。2026年4月末〜5月のMCPエコシステム成熟(Higgsfield MCP、Meta Ads MCP)を自社の広告運用業務にいち早く取り込み、Claudeに話しかけるだけで「競合調査→画像/動画生成→入稿→分析→改善」が一気通貫で動く環境を整備し、現在クライアント支援業務でも活用中です。

特徴は3点。

- Higgsfield MCPで30以上の画像/動画モデルを統合活用:Sora 2、Veo 3.1、Kling 3.0、Seedance 2.0、GPT Image 2、Soul 2.0、Nano Banana Proなど主要モデルを1つのMCPサーバーから呼び出し可能。シーン・テイスト・尺に応じて最適モデルを選定

- Soul Characterによるブランド一貫性の担保:1〜5枚の参照画像から学習したキャラクターIDを呼び出すだけで、複数シーンで同じモデル・同じトンマナを維持。広告キャンペーン全体の一貫性を構造的に確保

- PAUSED入稿による安全運用:AI経由で作成された広告は必ずPAUSED状態で作成し、人間が最終承認してから配信開始。広告費の暴走リスクを排除

仕組みの解説

[Step 1] 競合調査(Meta Ad Library活用)

- 同カテゴリーの上位広告の構成・コピー・ビジュアルを取得

- 共通点と差別化ポイントを分析

↓

[Step 2] 仮説立案(Claudeとの壁打ち)

- 既存配信データの勝ち素材・負け素材を分析

- 次の差し替えバリエーションの仮説を3〜5パターン設計

- 各バリエーションの「型」(フック、ベネフィット軸、ビジュアル方向)を確定

↓

[Step 3] Higgsfield MCPでクリエイティブ生成

- 画像:Soul Character利用でブランド一貫性を担保、4K解像度

- 動画:Marketing Studioプリセットで縦型UGC、TVスポット風、商品紹介など

用途別に並列生成

- 必要なクレジット上限はプロンプト側で明示

↓

[Step 4] Meta Ads MCPで入稿(PAUSED状態)

- 新キャンペーン/Ad Setに紐付け

- 既存の機械学習データを引き継ぐため、既存Ad Setを流用する設計

- 必ずstatus=PAUSEDで作成

↓

[Step 5] 人間による最終承認&配信開始

- クリエイティブの最終チェック

- ブランドガイドライン・媒体規定遵守の確認

- 承認後に配信ON

↓

[Step 6] 配信結果分析&次サイクルへ

- CTR/CPM/CPA/ROAS/Frequencyを取得

- 勝ち素材・負け素材の差分仮説を更新

- Step 1〜2へ戻り、次の差し替えへ使用ツール:Higgsfield MCP(画像・動画生成、30+モデル統合)、Claude(競合調査、仮説立案、ディレクション)、Meta Ads MCP(広告入稿、配信、分析)、Claude Code(定期実行・自動化スクリプト:必要に応じて)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1クリエイティブ制作期間 | 数日〜1週間 | 数十分〜数時間 | 大幅短縮 |

| 1セットあたり外注コスト | 数万〜数十万円 | 社内人件費+AIツール費のみ | 大幅削減 |

| 2ヶ月あたりの差し替え本数 | 制作リソース制約で限定的 | 50本以上(高予算案件で実証) | 桁違い |

| 当たりクリエイティブの発掘速度 | 月単位で1〜2本見つかれば良い方 | 週次〜半月単位で発掘可能 | 数倍 |

| ブランド一貫性の担保 | デザイナー個別判断 | Soul Characterで自動担保 | — |

| 配信→分析→改善サイクル | 1〜2週間 | 数日 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- Meta広告(Facebook / Instagram)に月数十万円以上を投下している

- 「当たりクリエイティブ発掘」が成果の主要レバーになっている

- 高頻度差し替えをやりたいが、デザイナー外注費・工数で制約されている

- ブランドガイドラインがある程度言語化されている

- 月予算が高い案件で、差し替え頻度向上の機会損失を解消したい

注意が必要な組織

- ブランドガイドラインが暗黙知に依存し、言語化されていない

- 商材特性上、AI生成素材の利用に制約がある業界(医療・金融等の規制)

- 広告予算が小さく、差し替え頻度を上げる必要性が低い

横展開のヒント

- Google広告のクリエイティブ生成:レスポンシブ検索広告の見出し・ディスクリプション、ディスプレイ広告のバナー一括生成

- TikTok広告・X広告:縦型動画・短尺動画の量産

- YouTube広告:サムネイル・15秒スポット動画の生成

- アフィリエイト用クリエイティブ:ASPに提供する素材セットの量産

- 多言語広告展開:1つのクリエイティブから多言語版バリエーションを派生

- A/Bテスト用バリエーション:コピー軸×ビジュアル軸の組み合わせ展開

運用ノウハウとピットフォール

運用上の工夫

- 「差し替え頻度」をKPIに据え直す発想転換が起点。「1本を早く作る」のではなく「同じ予算で何本試せるか」が成果を決める

- Soul Characterでブランド一貫性を担保することで、量産しても「バラバラなビジュアル群」にならない

- 既存Ad Setを流用することで、Meta側の機械学習の蓄積を活かしながら新素材をテストできる

- 月曜などに定例の改善ループを組み込み、「先週の勝ち素材分析→今週分の生成→入稿」を週次で回す設計

- Notion等に判断ログを蓄積し、勝ち負けパターンを組織資産化

陥りがちな失敗

- AI経由の広告をPAUSED状態にせず本番配信 → 想定外の課金リスク。必ず

status=PAUSEDを明示 - 完全自動化を志向しすぎて人間承認を省く → 広告費の暴走、ブランド毀損リスク。「人間の承認を残した自動化」が必須

- クレジット上限を指定せずに生成依頼 → AI側のクレジットが暴走。プロンプトで必ず上限明示

- 媒体規定違反の見落とし → 入稿前の自動チェックを必ず挟む

- ブランドトーンの逸脱 → Soul Characterの設定とブランドガイドラインの構造化で防ぐ

- 商用利用・肖像権・著作権の確認漏れ → 各モデルのTerms of UseとTrustページを事前確認、本人同意のない人物写真を学習素材にしない

Category F|PR・広報(1事例)

プレスリリースをはじめとするPR業務を、ブランド理解を持つAIに任せることで、配信頻度と品質を両立する事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| F-1 | プレスリリース制作の自動化 | 1本あたり 数時間 → 数10分/ブランドフィロソフィーを反映した品質を維持しつつ高速化 |

PR・広報業務、特にプレスリリース制作は、ブランド理解・正確性・トーンの一貫性が同時に求められる業務です。AIに丸投げすると独自性が失われ、人間が一から書くと工数が大きすぎる、というジレンマが長年の課題でした。本カテゴリーでは、ブランド理解を事前構造化したAIにプレスリリース制作を任せることで、配信頻度と品質を両立する設計を紹介します。

事例 F-1:プレスリリース制作の自動化

ブランドフィロソフィーや企業理解を事前学習したClaudeにプレスリリース制作を任せることで、1本あたり数時間かかっていた工数を数10分まで圧縮した事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 06. PR・広報 |

| 実装形態 | AIワークフロー(Claudeプロジェクト機能を活用したブランド事前学習型) |

業務概要

新規プレスリリース配信が決定した際の、原稿執筆業務。事前にブランドフィロソフィー・企業理解・トーン&マナーを学習させたClaudeに執筆を任せ、人間が最終承認するワークフロー。

Before:AI化前の課題

プレスリリースは企業発信の中でも特に正確性・公的なトーン・ブランド一貫性が求められる業務で、組織として工数面のボトルネックになりがちでした。

- 1本あたりの執筆に数時間が必要(情報整理、構成、執筆、推敲、確認)

- AIに丸投げすると、企業独自のトーンが失われ「最大公約数的で当たり障りのない文章」になる

- 人間が一から書くと工数が大きすぎ、配信頻度を上げられない

- ブランド理解が浅い担当者が書くと、企業のフィロソフィーが反映されず一貫性が崩れる

- 結果として、「発信すべきトピックはあるのに、リソース制約で配信頻度を上げられない」状態が常態化していた

アプローチ

Claudeプロジェクト機能に、企業のブランドフィロソフィー・ミッション・トーン&マナー・過去のプレスリリース・事業情報を事前学習させ、その上で個別案件のプレスリリースを執筆させる設計を採用しました。

特徴は2点。

- ブランド理解の事前構造化:企業のフィロソフィー・トーン・主張・禁止表現・公式情報源を構造化ドキュメントとしてClaudeに継承させる

- 個別案件の入力は最小限で完結:プレスリリースの「ネタ」(発表内容の事実)のみを入力すれば、ブランド理解を踏まえた原稿が瞬時に生成される

他のコンテンツ制作系事例(A-5 新規記事制作、A-6 ホワイトペーパー、A-7 セミナースライド)と同じ設計思想で、プレスリリース領域に適用しています。

仕組みの解説

[事前準備] Claudeプロジェクトにブランド情報を学習させる

- 企業のミッション・ビジョン・バリュー

- ブランドフィロソフィー・トーン&マナー

- 過去のプレスリリースアーカイブ

- 事業情報・主要サービスの定義

- 公式情報源・禁止表現

↓

[Step 1] 新規プレスリリース配信が決定

- 発表内容の事実情報を整理(誰が・何を・いつ・どこで・なぜ)

↓

[Step 2] Claudeに発表内容を伝達して執筆依頼

- 事前学習済みのブランド理解を踏まえて執筆

- タイトル、リード文、本文、企業情報の自動構造化

↓

[Step 3] 人間による最終承認&編集

- 数値・固有名詞・出典の最終確認

- ブランドガイドライン準拠の最終チェック

↓

[Step 4] 配信

- PR配信プラットフォーム・自社サイト等で配信使用ツール:Claude(Claude.aiプロジェクト:ブランド事前学習+執筆+推敲)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1本あたり執筆時間 | 数時間 | 数10分 | 大幅短縮 |

| ブランド一貫性 | 担当者の理解度に依存 | 事前学習で自動担保 | — |

| 配信頻度 | リソース制約で限定的 | 構造的に上げやすい | — |

| AI生成物の独自性 | 一般的なAI執筆だと「最大公約数的」になりがち | ブランドフィロソフィー反映で独自性確保 | — |

※社内運用の参考値。条件により変動します。

適用範囲

特に高いROIが期待できる組織

- プレスリリースを継続的に配信したい組織(資金調達、新サービス発表、業務提携、人事、調査リリース等)

- ブランドフィロソフィー・トーン&マナーがある程度言語化されている

- 配信頻度を上げたいがリソース制約で停滞している

- 広報専任者がおらず、マーケ担当者が兼務しているような体制

注意が必要な組織

- ブランドフィロソフィーが完全に暗黙知で、言語化が困難

- IR系の重大発表など、極めて高い正確性と法務確認が必要な領域(この場合は別途専門家レビューを推奨)

横展開のヒント

- メディア取材対応:取材依頼への回答文を、ブランド理解を踏まえてClaudeに下書きさせる

- 業界アワード応募書類:自社強みを業界文脈で再構成

- 登壇・寄稿依頼への回答:応募概要から回答ドラフトを自動生成

- 危機管理広報の初期ドラフト:想定問答集の作成(最終的には専門家レビュー必須)

- 社内向けお知らせ:社内Slackや全社メールの定型告知

運用ノウハウとピットフォール

運用上の工夫

- ブランド情報の事前学習が成否の8割を決める。フィロソフィー・トーン&マナー・過去事例を構造化してClaudeに渡す

- 過去のプレスリリースをアーカイブとしてClaudeに学習させると、文体・構成パターンが自然に継承される

- プレスリリースの定型構造(タイトル、リード、本文、企業情報、お問い合わせ先)をテンプレ化し、Claudeのプロジェクトに保存

- 配信後のメディア掲載状況・引用パターンをモニタリングし、次回以降の執筆にフィードバック

陥りがちな失敗

- ブランド情報の事前学習が浅い状態で執筆させると、「最大公約数的な文章」になる → 必ず事前学習を充実させる

- 数値・固有名詞・日付の確認をスキップ → 必ず人間の最終承認を経由

- 公的な発表で誤りがあると信頼毀損リスク → ファクトチェックを必須プロセス化

- ブランドガイドラインに反する表現(過剰な誇張、不正確な表現)→ プロンプトで禁止表現を明示

Category G|データ分析・効果測定(1事例)

マーケ業務の効果測定・レポーティングを公式API+AIで自動化し、コンサルタント・マーケターの時間を分析・提案に集中させる事例を紹介します。

| 事例No. | 事例名 | 主要成果 |

|---|---|---|

| G-1 | 月次レポーティング業務の自動化 | 10社契約時の月次転記作業 月10時間 → 月1時間未満/コンサルタントが分析・提案に集中可能に |

データ分析・効果測定は、マーケティング業務の中で「やらなければならない定型業務」が多い領域です。本来、コンサルタントやマーケターが時間を投下すべきは「数値からインサイトを抽出し、次の施策を提案する」業務ですが、実態は「ツールから数値を転記する」作業に多くの時間を奪われています。本カテゴリーでは、その構造的な工数浪費をAI+公式APIで解消する事例を紹介します。

事例 G-1:月次レポーティング業務の自動化

各種マーケティング業務(SEO・広告・SNS等)の月次効果測定レポートを、公式APIと集計スクリプトで自動生成し、コンサルタント・マーケターの転記作業を月数時間規模で削減する事例です。

🏠 自社事例

| 項目 | 内容 |

|---|---|

| 事例提供元 | シュワット株式会社(自社マーケティング業務) |

| 業界・規模 | マーケティング支援業 / 中小規模 |

| 公開範囲 | 仕組み・成果数値ともに全面公開(数値は社内運用の参考値) |

| 対象カテゴリー | 09. データ分析・効果測定 |

| 実装形態 | AIワークフロー(公式API+集計スクリプト+Excel自動更新の3段構成) |

業務概要

マーケティング支援業務(SEO・広告運用・SNS運用・CRM等)における、月次の効果測定レポート作成を自動化する業務。各種公式API(GA4、Search Console、Google広告、Meta広告等)からデータを取得し、月次レポートExcelの該当月実績列を自動更新する。

Before:AI化前の課題

マーケティングコンサルティングや支援業務において、月次の効果測定レポート作成は避けて通れない業務ですが、ツールから数値を手作業で転記する作業は、組織として大きな工数浪費になっていました。

- 1社あたり毎月30分〜1時間をデータ転記作業に消費

- クライアントが10社あれば月5〜10時間がレポート転記に固定で奪われる

- コンサルタント・マーケターの本来業務である「分析・提案」にあてるべき時間が、データ転記に奪われている状態

- 契約社数が増えるほど工数が線形に増加し、事業のスケーラビリティを阻害

- 結果として、コンサルティングの付加価値(分析・提案)に投下できる時間が減り、顧客満足度・継続率にも影響していた

アプローチ

GA4・Search Console・Google広告・Meta広告等の主要マーケティングツールは、ほぼすべて公式APIを提供しています。これらをNode.jsスクリプトで自動取得し、月次レポートExcelの自動更新を組み合わせることで、「ボタン1つで前月実績が転記された状態のExcelが生成される」運用を構築。

特徴は3点。

- 公式APIによる正確かつ自動的なデータ取得:手動操作ゼロ、転記ミスゼロ

- 既存Excelテンプレートとの統合:CTR・CVR等の数式セルは触らず、生の実績値のみ更新することで、既存の計算ロジックや書式を完全に保持

- 横展開のスケーラビリティ:1つのスクリプトで複数クライアントを管理可能。新規クライアント追加時は環境設定の切り替えだけで対応可能

仕組みの解説

[各種公式API]

- GA4 API(アクセス解析)

- Search Console API(自然検索)

- Google広告API(リスティング・ディスプレイ)

- Meta広告API(Facebook・Instagram広告)

- その他チャネルAPI(X広告、TikTok広告、MA、CRM等)

↓

[Step 1] サービスアカウント発行+クライアント環境への権限付与

- Google Cloud Console等で発行された

プログラム用アカウントを、クライアントの各種ツールに

「閲覧者」として追加

- 1度の権限付与で、以降は依頼不要

↓

[Step 2] Node.js 集計スクリプトでデータ取得

- 各APIから月初〜月末の期間で必要指標を取得

- データソース別にモジュール化

(API取得 / データ加工 / 出力フォーマット)

↓

[Step 3] 月次レポートExcel自動更新

- 該当月の実績列のみに値を書き込み

- 既存の数式セル(CTR・CVR等)は保持

↓

[Step 4] 出力データの目視確認(dryrun)

- 異常値検知のための事前確認

- 異常があれば原因調査

↓

[Step 5] 本実行+社内データ補完

- 確認完了後、Excel更新を本実行

- 社内データ(制作本数等)のみ手入力で補完

↓

[出力] 完成した月次レポートExcel使用ツール:Node.js(集計スクリプト実装)、各種公式API(GA4 / Search Console / 広告プラットフォーム等)、ExcelJS等のライブラリ(既存Excel更新)、Claude / Claude Code(スクリプト設計・実装・拡張)

After:成果

| 指標 | Before | After | 改善率 |

|---|---|---|---|

| 1社あたり月次レポート工数 | 30分〜1時間 | 数分(dryrun確認+社内データ補完のみ) | 約90%削減 |

| 10社契約時の月次工数 | 月5〜10時間 | 月1時間未満 | 約90%削減 |

| 転記ミスの発生 | ヒューマンエラーで一定数発生 | ゼロ(API直接取得) | — |

| 新規クライアント追加時の工数増 | 比例して線形増加 | ほぼ増えず(環境切替のみ) | — |

| コンサルタントの分析・提案時間 | データ転記に圧迫 | 大幅に増加 | — |

※社内運用の参考値。条件により変動します。

横展開のヒント

このワークフロー設計は、SEO以外の領域にも幅広く適用可能。

- 広告運用の月次レポート:Google広告API、Meta広告API、X広告API等の各種広告プラットフォームから運用実績を自動取得

- SNS運用の月次レポート:X、Instagram、TikTok、YouTube等の公式APIから投稿成果・フォロワー推移を自動取得

- MA・CRMのレポーティング:HubSpot、Salesforce、Marketo等のAPIからリード獲得・ナーチャリング指標を自動取得

- EC運営のレポーティング:Shopify、楽天、Amazon等のAPIから売上・購入動向を自動取得

- 複数チャネル統合レポート:全チャネルのデータを統合した経営層向けダッシュボード自動生成

- 異常検知の自動アラート:閾値を超えた指標変動を検知し、Slack等へ自動通知

業界・業種を問わず、「公式APIが提供されているサービスのレポーティング業務」はすべて同じ設計思想で自動化可能です。

適用範囲

特に高いROIが期待できる組織

- マーケティングコンサルティング・支援を行っており、複数社の月次レポートを継続的に作成している

- 1社あたりのレポート工数が30分以上かかっており、契約社数が10社以上ある

- コンサルタント・マーケターの時間を分析・提案にシフトしたい

- 公式APIが提供されている主要ツール(GA4、各種広告プラットフォーム、SNS等)を扱っている

注意が必要な組織

- 公式APIが提供されていない独自ツールが主要データソース

- レポートの構造がクライアントごとに完全に異なり、テンプレート化が困難

- セキュリティポリシー上、外部API連携が制限されている

運用ノウハウとピットフォール

運用上の工夫

- 2段階実行(dryrun → 本実行)の徹底:dryrunで値を目視確認してから本実行する構成にすることで、API取得値の異常を早期発見できる

- モジュール分割設計:データ取得(API別)、データ加工、Excel更新を分割実装することで、特定APIの仕様変更や新規データソース追加に柔軟に対応可能

- 環境変数による複数クライアント管理:1つのスクリプトで複数クライアントを管理し、

.envの切り替えだけで運用 - 数式セルの保持:CTR・CVR等の計算式は触らず、実績値のみ更新することで既存の計算ロジックと書式を完全に保持

- 権限の最小化:サービスアカウントは「閲覧者」権限のみ付与し、書き込み権限は不要にする

陥りがちな失敗

- API鍵ファイルの管理:サービスアカウントの鍵ファイルは実質的なパスワード。Gitリポジトリに含めず、

.gitignoreでの除外を徹底 - APIクォータ超過:GA4 Data APIは1日25,000リクエストの上限あり。月次運用なら問題なくとも、頻繁に取得する設計には注意

- 匿名化データの誤解釈:Search Consoleの少数表示クエリは匿名化されるため、ロングテール指標は実数より少なめに出る。レポート上でこの仕様を明記しておく

- dryrunスキップでの直接本実行:API取得値の異常を見逃すリスク。必ず2段階実行のルール化を徹底

- クライアントへの説明不足:サービスアカウントの権限付与依頼の文面をテンプレ化し、クライアントが5分で対応できるレベルに整備

掲載事例から見えた共通パターン

ここまでの事例を通じて、マーケティング業務AI化の共通パターンが見えてきました。

本章では、自社事例・他社支援事例の双方から抽出した知見を整理します。

共通する成功要因

成功事例には、業界・業務を問わず共通する3つの設計要因がありました。

要因① 業務の徹底的な分解

すべての成功事例で、まず行われていたのは「業務の徹底的な分解」でした。「記事リライト」を1つのタスクと見なすのではなく、「上位記事分析」「差分マップ作成」「海外リサーチ」「構成設計」「原稿生成」と、5〜10のサブタスクに分解する。

各サブタスクごとに、AI化の難易度・最適な実装形態・期待されるROIを評価することで、初めて全体設計が可能になります。

要因② 「半自動化」の積極採用

掲載事例すべてが、最終出力を人間の編集者が承認・編集する半自動化の設計を採用しています。完全自動化は理論上可能でも、品質リスク・ブランド毀損リスクを考慮すると、現実的な最適解は「AIが下案、人が承認」です。

この設計により:

-

- AI出力の品質が安定しないフェーズでも安全に運用開始できる

-

- 編集者の承認データが、AIの継続学習データになる

-

- 万が一の品質問題が、本番に到達する前に止められる

要因③ 運用通じた継続改善

すべての実装は、初回リリース時点では「最低限動く状態」でした。運用を続けるなかで以下のサイクルを回しています。

運用 → 失敗パターンの発見 → プロンプト/フロー改善 → 再運用このサイクルを月次〜四半期で回すことで、6ヶ月後には初期版とは別物の品質に到達します。AI実装は「作って終わり」ではなく、「育てる」資産です。

工数削減の典型パターン

掲載事例の工数削減率を一覧化すると、以下のパターンが見えます。

| 業務性質 | 削減率 | 該当事例 |

|---|---|---|

| 大量繰り返し型(定型処理) | 90〜95% | 順位改善リライト/内部リンク最適化 |

| 探索・発掘型 | 85〜95% | 速報挿入リライト/被リンク営業リスト |

| パーソナライズ型 | 85〜90% | 被リンク営業文/サービスLP一括生成 |

| 分析・判断型 | 70〜85% | CTR改善リライト |

「大量繰り返し型」は最も削減率が高く、ROIも明確。AI化の優先順位として最初に着手すべき領域です。

AIに任せない領域

掲載事例すべてで、人間が担い続けている領域があります。

-

- 戦略判断:何のためにこの業務を行うのか、どの方向に向かうべきか

-

- 品質基準の設定:何を「良い出力」とするか、ブランドとして許容するか

-

- 最終承認:本番公開前のレビューと承認

-

- 例外対応:AIが判断に迷うケースのハンドリング

-

- 改善方針の決定:AIの出力品質をどう向上させるか

これらは、AI実装の「監督役」「品質責任者」「方向付け役」として、人間の高度な判断が必要な領域です。AI化が進むほど、これらの役割の重要性は増します。

組織的インパクト

複数のAI実装が稼働することで、組織には以下のような変化が起きます(シュワット社内および支援先で観測されたパターン)。

-

- マーケチームが「実行する人」から「設計・監督する人」にシフト

-

- 1人あたりの担当業務範囲が3〜5倍に拡大

-

- 業務の属人化が大幅に解消(誰が休んでも業務が止まらない)

-

- 新規業務領域への参入スピードが向上(AI化テンプレートが流用可能)

これらの組織的変化こそが、AX(AIトランスフォーメーション)の本質的価値です。

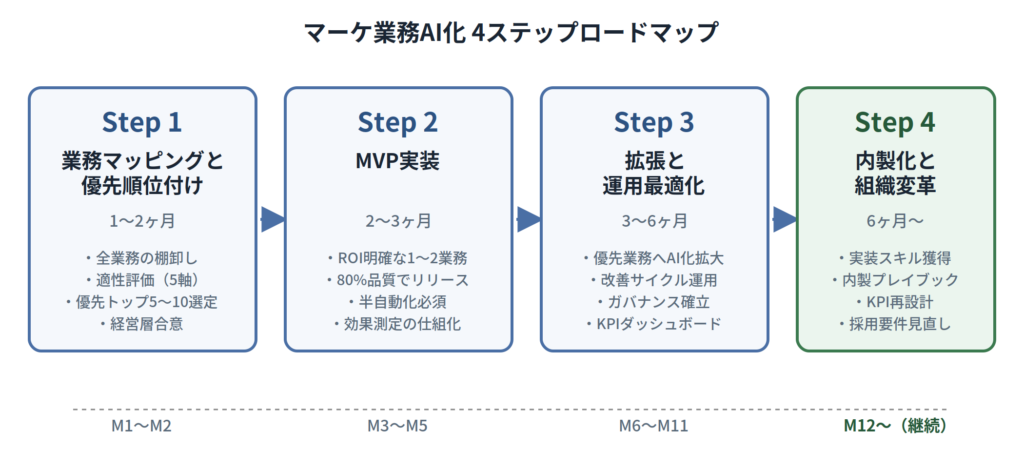

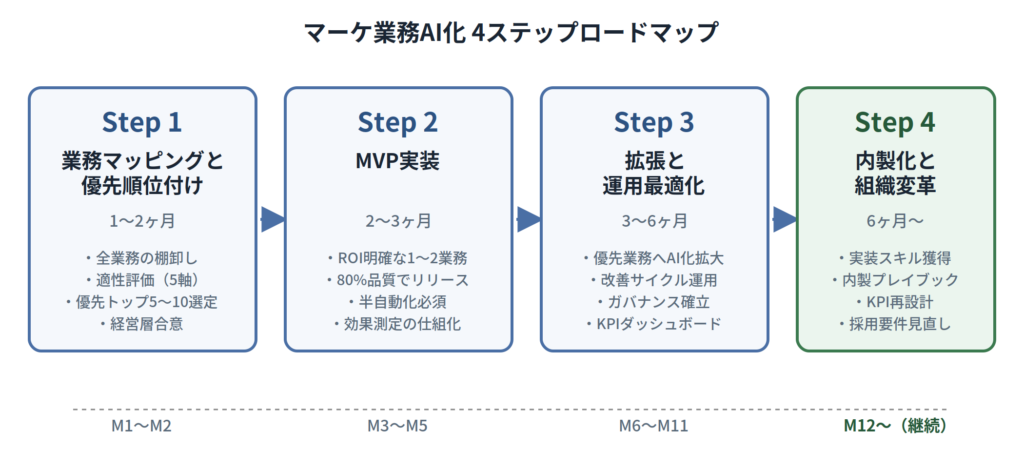

AI化を進めるための4ステップアプローチ

実際に自社でマーケ業務AI化を進める際の、推奨ステップを紹介します。

Step 1:業務マッピングと優先順位付け(1〜2ヶ月)

AX推進の出発点として、全業務を棚卸しし、AI化の優先順位を確定するフェーズです。

やること:

-

- 全マーケ業務の棚卸し(12カテゴリーマップを使用)

-

- 各業務の工数・属人化度・AI化適性の評価

-

- AI化優先業務 トップ5〜10 の選定

成果物:

-

- 業務マップ(As-Is)

-

- AI化優先順位リスト

-

- 各優先業務のROI試算

失敗を避けるポイント:

-

- 「全業務を1度にAI化」を目指さない(リソース分散で全部失敗する)

-

- AI化適性スコアが低い業務(属人的・技術未成熟)に手を出さない

-

- 経営層の合意を、このステップで必ず取る

Step 2:MVP実装(2〜3ヶ月)

最もROIが明確な業務に絞り込み、80%品質で本番稼働させる、最初の実装フェーズです。

やること:

-

- 優先業務のうち、最もROIが明確な1〜2業務を選定

-

- 業務分解 → 実装形態選定 → プロトタイプ開発

-

- ステージング環境での品質検証

-

- 本番リリースと初期運用

成果物:

-

- 1〜2業務の本番稼働AI実装

-

- 運用マニュアル

-

- 初期の効果測定レポート

失敗を避けるポイント:

-

- 完璧を目指さない(80%品質で運用開始し、運用しながら改善)

-

- 必ず半自動化(人の承認ステップ)を含める

-

- リリース後すぐに効果測定の仕組みを稼働させる

Step 3:拡張と運用最適化(3〜6ヶ月)

優先業務全体にAI化を広げ、運用ガバナンスとKPIダッシュボードを整備するフェーズです。

やること:

-

- 残りの優先業務へのAI化拡大

-

- 既存実装の改善サイクル運用

-

- 業務横断的なデータ・知見の蓄積

-

- ガバナンスフレームワークの確立

成果物:

-

- 5〜10業務のAI化稼働

-

- 運用ガバナンス体制

-

- KPIダッシュボード

失敗を避けるポイント:

-

- 個別実装を作りっぱなしにしない(横断的な改善・連携を意識)

-

- 運用工数が肥大化しないよう、初期から自動化・標準化

-

- 経営層への定期報告(少なくとも月次)を欠かさない

Step 4:内製化と組織変革(6ヶ月〜)

外部依存から自走運用への移行と、組織のあり方そのものをAI前提に再設計するフェーズです。

やること:

-

- マーケチームのAI実装スキル獲得

-

- 内製プレイブックの整備

-

- 役割・KPIのAI前提への再設計

-

- 採用要件の見直し

成果物:

-

- 内製可能な組織体制

-

- AI前提の組織図・KPI

-

- 新しい採用基準と教育プログラム

失敗を避けるポイント:

-

- 外部依存のまま運用継続(コストが嵩む、改善が遅い)

-

- 「AIに仕事を奪われる」不安への対処を怠る → 役割の再定義と教育で乗り越える

-

- 既存KPIに固執 → AI前提の新しい評価指標を設計する

AI化でよくある5つの失敗パターン

実際にマーケAI化を試みた多くの組織が陥る失敗パターンを、5つに分類して紹介します。

失敗① ツール導入で満足してしまう

「ChatGPT Enterpriseを全社導入した」「Notion AIを使い始めた」で、AX完了と勘違いしてしまうパターン。

実態:個々の従業員のタスクが少し早くなるだけで、業務フロー全体は変わらない。組織として再現性のあるアウトプット向上にはつながらない。

処方箋:ツール導入は「下準備」と位置づけ、業務再設計を別タスクとして必ず実施する。

失敗② 戦略なき実装に走る

「とにかくAIで何か作ってみよう」と、業務分析や優先順位付けをスキップして実装に着手するパターン。

実態:作ったAIが業務の本筋から外れていて、結局使われない。または、もっと優先度の高い業務が放置されたまま。

処方箋:必ずStep 1(業務マッピングと優先順位付け)に1〜2ヶ月かける。急がば回れ。

失敗③ 完璧を目指して何もリリースできない

「AI出力の品質が100%にならないとリリースできない」と考え、永遠にステージング環境で改善を続けるパターン。

実態:6ヶ月経っても本番リリースできず、プロジェクトが頓挫。経営層からの信頼を失う。

処方箋:80%品質で本番リリースし、人の承認ステップで品質を担保する半自動化設計。運用しながら改善する。

失敗④ 効果測定を後回しにする

「とにかく作って動かしている」状態で、ROIや業務指標を計測していないパターン。

実態:効果が見えないため経営層の継続支援が得られず、プロジェクトが縮小・終了する。

処方箋:リリース時点で効果測定の仕組みを必ず組み込む。月次でROIを経営報告する。

失敗⑤ 内製化を見据えない外注継続

外部ベンダーに開発・運用を任せきりで、社内にノウハウが蓄積しないパターン。

実態:ベンダーへの支払いが永続化し、改善判断もベンダー依存。AI実装が組織資産にならない。

処方箋:契約時点で「内製化移行」をスコープに含める。最低でも運用は内製化、できれば改善も内製化する。

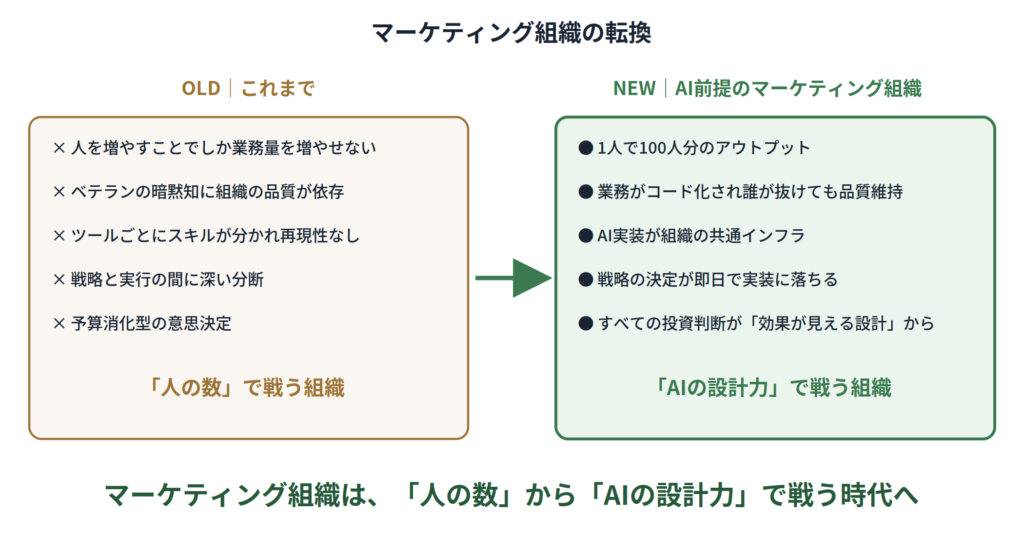

まとめ:マーケティング組織のあり方を再定義する

マーケティングのAI活用は、単なる業務効率化のテーマではありません。

組織のあり方そのものを書き換える話です。

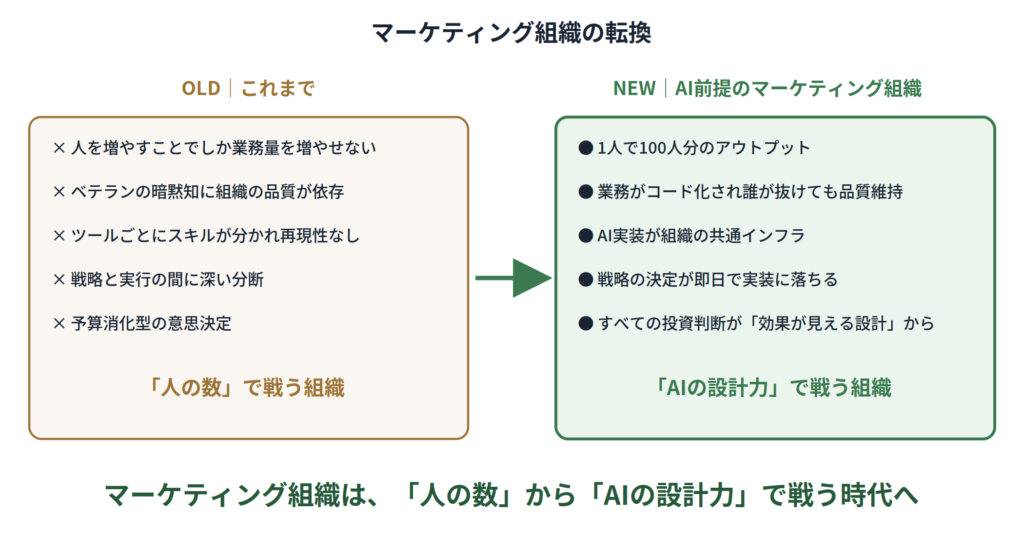

下表は本記事のテーマを、対比でまとめたものです。

| OLD|これまでのマーケティング組織 | NEW|AI前提のマーケティング組織 |

|---|---|

| 人を増やすことでしか業務量を増やせなかった | 1人で100人分のアウトプットを出せる |

| ベテランの暗黙知に組織の品質が依存していた | 業務がコード化され、誰が抜けても品質が落ちない |

| ツールごとに使い手のスキルが分かれ、再現性が出なかった | AI実装が組織の共通インフラとなり、全員が同じ武器を持つ |

| 戦略と実行の間に深い分断があった | 戦略の決定が即日で実装に落ちる |

| 予算消化型の意思決定が、効果を見失わせた | すべての投資判断が「効果が見える設計」から始まる |

マーケティング組織は、「人の数」で戦う時代から、「AIの設計力」で戦う時代に入りました。

本記事に掲載した事例は、その移行の最初の一歩です。事例数は今後も増えていきます。新たな実装が生まれるたびに、本記事はアップデートされ、より包括的なガイドへと成長していきます。

よくある質問

みなさまからいただく代表的な質問と回答をまとめました。

AIに詳しい人材が社内にいません。それでも始められますか?

始められます。ただし、Step 1(業務マッピングと優先順位付け)から自社で進めるのは難易度が高いため、外部支援の活用を推奨します。シュワットでは「AIX研修プラン」(3ヶ月、200万円〜)でも内製化スキルの立ち上げが可能です。

1年で本当に業務の50〜70%をAI化できますか?

対象業務の選定次第です。定型度の高い業務(記事制作、データレポーティング、リサーチなど)に絞れば実現可能性は高く、創造的判断業務は対象外として設定します。事前診断で「AI化適性スコア」を算出することで、現実的な目標値を設定できます。

AIエージェントとAIワークフローの違いは何ですか?

AIエージェントは「自律的な判断と行動」を伴う実装、AIワークフローは「定められた手順をAIが実行する」実装です。前者は柔軟性、後者は制御性に強みがあります。本記事の章2で詳しく解説しています。

AI実装にかかるコストはどれくらいですか?

業務の難易度・実装形態によります。シュワットの内部実績では、1業務のAI化に2〜3ヶ月の開発期間と、社内エンジニア工数で換算すると数百万円規模が一般的です。外注する場合は、開発費用に加えて運用費用が継続的に発生します。

AIに業務を任せて品質は大丈夫ですか?

掲載事例すべてで「半自動化」(AI出力を人が承認するステップを含む)を採用しています。完全自動化は品質リスクが大きいため、まずは半自動化から始めることを強く推奨します。

自社の業務がAI化に適しているか、どう判断すれば良いですか?

本記事の章3で紹介した5軸フレームワーク(工数規模・定型度・AI技術成熟度・ROI明確性・リスク水準)で評価できます。より詳細な30項目チェックリストはホワイトペーパー「マーケティング業務AI自動化事例集」の巻末に掲載しています。

事例にあるAI実装は、自社でも導入できますか?

各事例の「適用範囲」「横展開のヒント」を参照ください。再現性の高い組織条件を明記しています。シュワットの「マーケティングAIX」サービスでは、これらの実装を自社業務に最適化した形で導入支援も行っています。

関連リソース

本記事を読み終えた方が次のアクションを取りやすいよう、関連リソースをまとめています。

詳細ガイドのダウンロード

本記事の内容に加え、AI化適性診断チェックリスト(30項目)や追加の運用ノウハウを収録した完全版ホワイトペーパーを無料配布しています。

マーケティングAIX サービス紹介

本記事で紹介した事例の構築・運用を担うチームが、御社のマーケティング業務AI化を伴走支援します。

| プラン | 期間 | 価格 |

|---|---|---|

| AIX研修プラン | 3ヶ月 | 200万円〜 |

| AIXコンサルティング | 6〜12ヶ月 | 月60万円〜+初期80万円 |

| AIX導入支援 | 12〜18ヶ月 | 月120万円〜+初期200万円 |

無料相談

30分のオンライン無料相談を受け付けています。現状の課題と方向性をヒアリングし、最適なアプローチを提案します。